MiniMind — 500원·GPU 1장으로 나만의 AI 모델 직접 훈련하기

그래픽카드 1장, 500원, 2시간이면 나만의 AI를 처음부터 만들 수 있습니다. 깃허브 스타 4.2만 돌파한 오픈소스 MiniMind로 AI 모델 훈련의 전 과정을 직접 경험해보세요.

• 로컬 AI 문서 검색 시스템 구축 — Ollama RAG 7주 무료 강좌

• 스타 33만 OpenClaw에 악성 스킬 283개가 숨어 있었다 — 3만 대가 인터넷에 무방비 노출

• Obsidian CEO가 직접 AI에게 자기 앱 사용법을 가르쳤습니다 — 무료 공개, 스타 1만 6천

ChatGPT를 만드는 데 수천억 원이 들었다는 이야기는 이제 상식이 됐습니다. 그런데 500원이면 나만의 AI 모델을 처음부터 훈련할 수 있다면 어떨까요? 오픈소스 프로젝트 MiniMind가 바로 그 일을 가능하게 합니다. 깃허브 스타 4만 2천 개, 오늘 하루에만 478개가 추가됐습니다.

GPT-3의 7,000분의 1 크기인데 대화가 된다

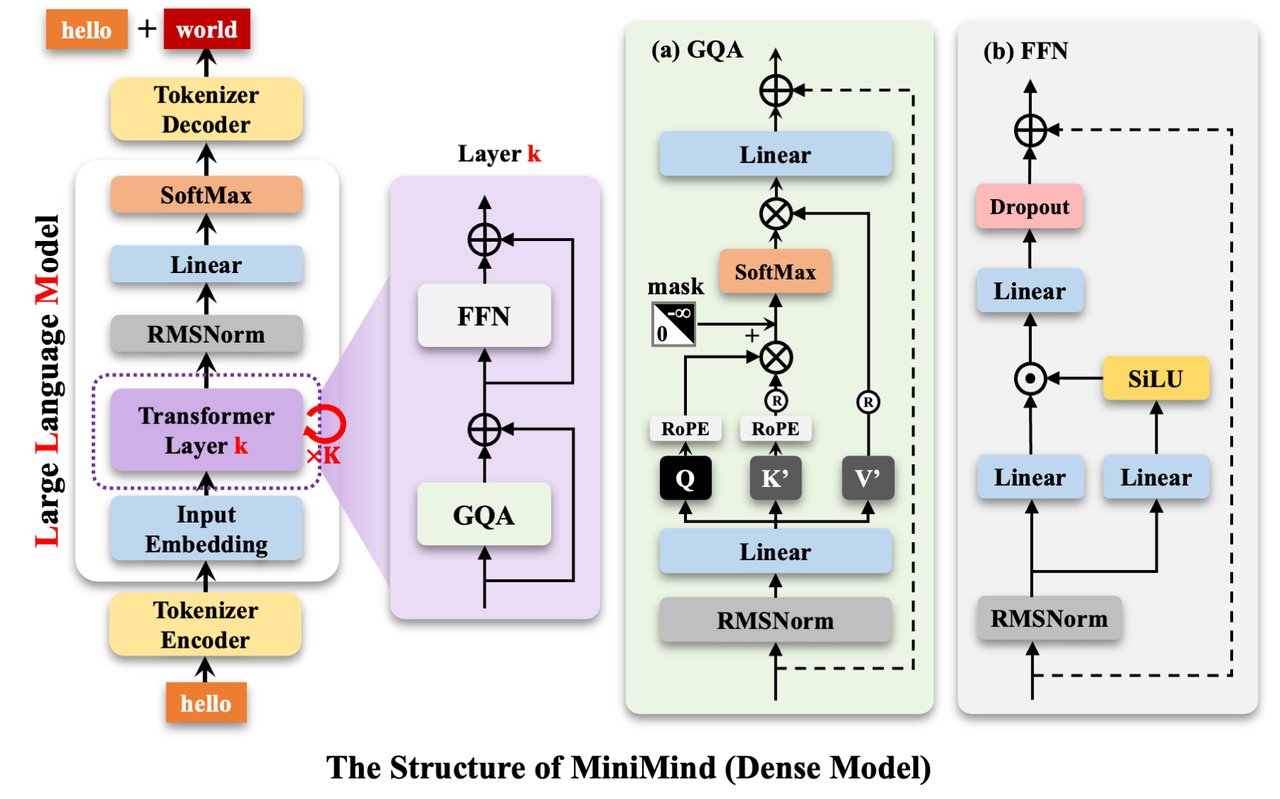

MiniMind는 2,600만 개의 파라미터(AI의 '뇌세포' 수)로 이루어진 초소형 AI 모델입니다. GPT-3가 1,750억 개인 것과 비교하면 약 7,000분의 1 크기입니다. 그런데 이 작은 AI가 실제로 대화를 하고, 질문에 답하고, 중국어와 영어를 이해합니다.

핵심 수치를 정리하면 이렇습니다.

🔢 MiniMind 핵심 스펙

• 가장 작은 모델: 2,600만 파라미터 — 메모리 0.5GB면 충분

• 훈련 시간: 그래픽카드(GPU) 1장으로 약 2시간

• 훈련 비용: 클라우드 서버 대여 기준 약 500원

• 프레임워크: 100% 순수 PyTorch — 외부 라이브러리 없이 직접 구현

• 라이선스: Apache 2.0 — 개인·상업 모두 무료

500원으로 AI를 '처음부터' 만드는 과정

MiniMind의 가장 큰 매력은 AI 모델 훈련의 전체 과정을 A부터 Z까지 경험할 수 있다는 점입니다. ChatGPT 같은 대형 AI가 어떻게 만들어지는지 궁금했던 분이라면, 이 프로젝트가 그 과정을 축소판으로 보여줍니다.

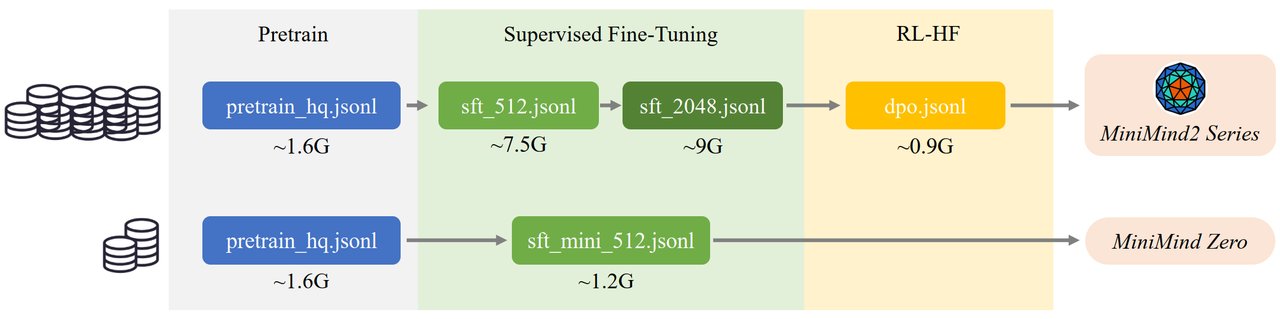

훈련은 3단계로 이루어집니다.

1단계: 사전 훈련 (약 1시간)

1.6GB 분량의 텍스트 데이터를 읽으며 언어의 기본 패턴을 배웁니다. 사람으로 치면 '글을 읽고 이해하는 법'을 배우는 단계입니다.

2단계: 대화 훈련 (약 1시간)

질문-답변 형태의 데이터 1.2GB를 학습합니다. '사용자가 물어보면 이렇게 답해야 한다'는 대화 규칙을 익히는 단계입니다.

3단계: 보상 학습 (선택)

좋은 답변과 나쁜 답변을 비교해서 품질을 높이는 RLHF(사람의 피드백으로 AI를 개선하는 기술) 과정입니다. DPO, PPO, GRPO 등 여러 방식을 직접 실험해볼 수 있습니다.

이 정도로 작은 AI가 쓸 만할까?

솔직히 말하면, MiniMind는 ChatGPT를 대체하는 도구가 아닙니다. AI가 어떻게 작동하는지 배우는 '교육용 키트'에 가깝습니다. 하지만 그 성능이 의외로 쓸 만합니다.

객관 평가(C-Eval 등 중국어 시험)에서 MiniMind2(104M)는 26.52점을 기록했습니다. 놀라운 점은 40배 큰 TinyLlama(1.1B)의 25.48점보다 오히려 높다는 것입니다.

주관 평가(DeepSeek-R1이 채점)에서는 100점 만점에 96점을 받아 비교 대상 중 1위를 차지했습니다. 작은 모델인데도 답변이 논리적이고 완성도가 높다는 평가입니다.

모델 3종 — 상황에 맞게 고르면 된다

MiniMind2-Small (26M)

가장 가벼운 모델. 메모리 0.5GB, 훈련 2시간, 비용 약 500원. AI 입문용으로 최적.

MiniMind2 (104M)

표준 모델. 메모리 1GB, 벤치마크 성능 최고. TinyLlama 1.1B보다 높은 점수를 기록.

MiniMind2-MoE (145M)

MoE(전문가 혼합 방식 — 질문에 따라 다른 전문가 모듈이 답하는 구조) 아키텍처 적용. 같은 크기로 더 다양한 답변 가능.

MiniMind 설치와 실행 — 지금 바로 시작하는 방법

Python과 NVIDIA 그래픽카드(GTX 1060 이상이면 가능)가 있다면 바로 시작할 수 있습니다. AI 개발 환경 구성이 처음이라면 AI 환경 세팅 가이드에서 기본 준비 과정을 확인해보세요.

이미 훈련된 모델을 다운로드해서 대화하기:

# 프로젝트 다운로드

git clone https://github.com/jingyaogong/minimind.git

cd minimind

pip install -r requirements.txt

# 이미 훈련된 모델 다운로드

git clone https://huggingface.co/jingyaogong/MiniMind2

# 대화 시작

python eval_llm.py --load_from ./MiniMind2처음부터 직접 훈련하기:

# 1단계: 사전 훈련 (약 1시간)

python train_pretrain.py

# 2단계: 대화 훈련 (약 1시간)

python train_full_sft.py

# 내가 만든 AI와 대화해보기

python eval_llm.py --model_mode 1웹 브라우저에서 대화하고 싶다면 streamlit run web_demo.py 한 줄로 웹 UI를 띄울 수 있습니다. OpenAI 호환 API도 제공되어 Open-WebUI, Dify 같은 도구와도 바로 연동됩니다. 다양한 API 활용법이 궁금하다면 API 연동 실전 가이드도 참고해보세요.

Ollama와 llama.cpp에서도 돌아간다

MiniMind는 이미 잘 알려진 로컬 AI 실행 도구와도 호환됩니다. Ollama(내 컴퓨터에서 AI를 쉽게 실행하는 도구), llama.cpp(AI 모델을 가볍게 변환해서 돌리는 도구), vLLM 등을 지원합니다. 그래픽카드 없이 CPU만으로도 실행이 가능하며, 여러 대의 GPU가 있다면 분산 훈련도 명령어 한 줄로 할 수 있습니다.

# GPU 여러 장으로 분산 훈련

torchrun --nproc_per_node 4 train_pretrain.py왜 4만 2천 명이 스타를 눌렀을까

AI를 배우고 싶은 사람에게 MiniMind가 매력적인 이유는 분명합니다. 대부분의 AI 교육 자료가 '이론'에서 끝나거나, 이미 만들어진 모델을 '사용'하는 법만 알려줍니다. MiniMind는 그 사이의 빈 공간 — 실제로 AI를 처음부터 만들어보는 경험 — 을 채워줍니다.

특히 주목할 점은 모든 코드가 순수 PyTorch로 작성됐다는 것입니다. HuggingFace Transformers 같은 추상화 라이브러리(복잡한 부분을 숨겨주는 편의 도구)를 쓰지 않았기 때문에, AI 모델 내부에서 무슨 일이 일어나는지 한 줄 한 줄 따라가며 이해할 수 있습니다.

최근에는 DeepSeek-R1 스타일의 추론 모델 증류(큰 AI의 '생각하는 능력'을 작은 AI에게 전수하는 기술)까지 추가됐습니다. AI 업계의 최신 기술을 500원짜리 미니 모델에서 직접 실험해볼 수 있는 셈입니다.

이런 분에게 추천합니다

• AI에 관심 있는 대학생/취준생 — 면접에서 'AI 모델을 직접 훈련해봤다'는 경험은 강력한 무기가 됩니다

• ChatGPT를 쓰면서 '이게 어떻게 작동하지?' 궁금했던 분 — AI의 내부 구조를 손으로 만지며 이해할 수 있습니다

• AI 스타트업을 준비하는 개발자 — 서비스에 맞는 초소형 AI를 직접 만들어 탑재할 수 있습니다

• AI 교육자/강사 — 학생들에게 실습 과제로 활용하기 좋은 프로젝트입니다

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기