Ollama v0.18.3 VS Code 무료 AI 코딩 — 명령어 한 줄, 구독료 0원

GitHub 스타 16만의 Ollama가 VS Code에 공식 통합됐습니다. ollama launch vscode 한 줄로 설정 완료, 구독료 0원. Copilot·Cursor 없이 내 컴퓨터에서 무료 AI 코딩을 시작하세요.

• Ollama v0.18.3이 VS Code 채팅 사이드바에서 바로 AI 코딩을 지원합니다

•

ollama launch vscode 명령어 한 줄이면 설정이 끝납니다• KV 캐시 공유(이전 대화의 맥락을 기억하는 기능)로 같은 프로젝트 작업 시 응답이 빨라졌습니다

• 100% 무료이고 코드가 외부 서버로 나가지 않습니다 — GitHub 스타 16만 6천, 월 다운로드 5,200만 회

AI가 코드를 짜주는 도구는 이미 많습니다. GitHub Copilot은 월 10달러, Cursor Pro는 월 20달러입니다. 그런데 Ollama는 같은 일을 내 컴퓨터에서 무료로 합니다. 세계에서 가장 많이 쓰이는 로컬 AI 실행 도구이고, 40,000개 이상의 앱과 서비스가 Ollama와 연동됩니다.

문제는 지금까지 Ollama를 쓰려면 터미널(검은 화면에 명령어를 입력하는 창)에서 직접 대화해야 했다는 것입니다. 코딩하다가 터미널로 왔다 갔다 하는 건 불편합니다. v0.18.3부터는 VS Code 안에서 바로 Ollama 모델을 쓸 수 있습니다.

Ollama로 VS Code에서 바로 AI 코드 질문하기

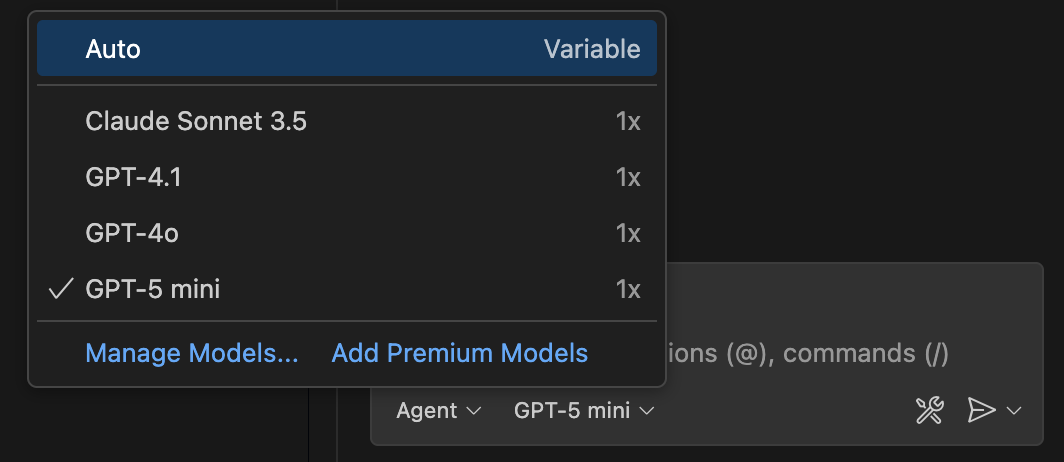

이제 VS Code의 채팅 사이드바에서 Ollama 모델을 직접 선택할 수 있습니다. 코드를 짜다가 막히면 옆 패널에서 AI에게 바로 질문하면 됩니다. 별도 확장 프로그램을 설치하지 않아도 VS Code의 기본 모델 관리 기능에 Ollama가 바로 연결됩니다.

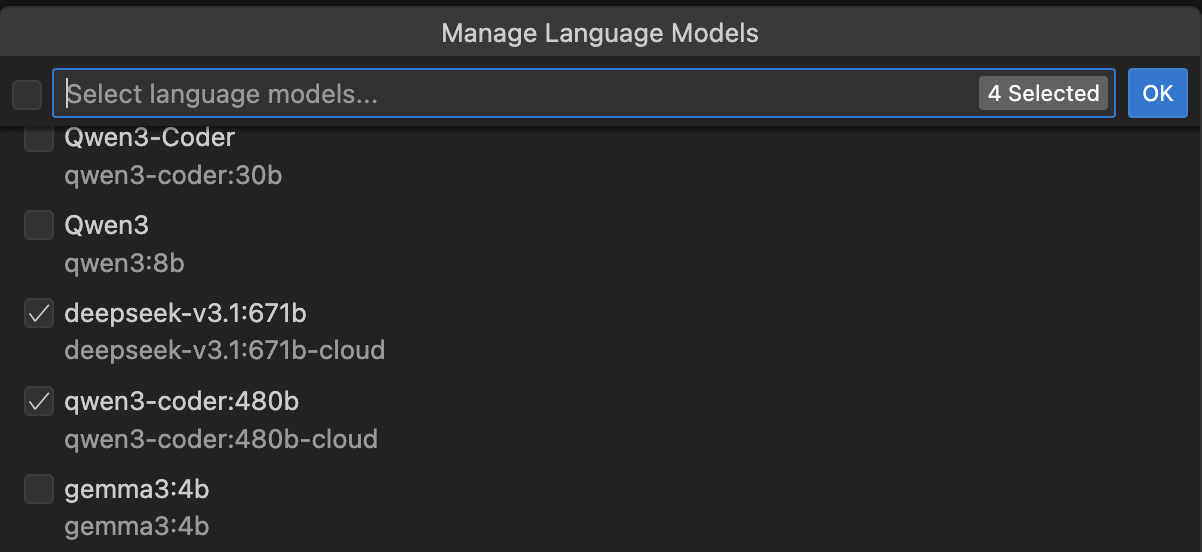

모델 드롭다운에서 Manage Models를 클릭하면 Ollama에서 내려받은 모델이 자동으로 표시됩니다. 원하는 모델을 체크하면 바로 사용할 수 있습니다.

위 화면에서 볼 수 있듯이 Qwen3-Coder 30B, DeepSeek v3.1, Gemma3 4B 등 다양한 오픈소스 AI 모델을 VS Code 안에서 골라 쓸 수 있습니다. 작은 모델은 내 컴퓨터에서 직접 돌아가고, 큰 모델(480B, 671B)은 Ollama 클라우드를 통해 실행할 수도 있습니다.

Ollama VS Code 연동 — 5분 만에 설정 완료하는 방법

시작하려면 세 단계만 거치면 됩니다.

Mac이나 Linux라면 터미널에서 아래 한 줄을 복사해서 붙여넣으면 됩니다. Windows는 ollama.com에서 설치 파일을 받을 수 있습니다.

curl -fsSL https://ollama.com/install.sh | sh코딩용으로 추천하는 모델을 하나 받아둡니다. 8GB RAM이면 아래 가벼운 모델이 적합합니다.

# 코딩 전문 모델 (30B, 약 18GB 저장공간)

ollama pull qwen3-coder:30b

# 가벼운 범용 모델 (4B, 약 2.5GB 저장공간)

ollama pull gemma3:4b터미널에서 아래 명령어를 실행하면 VS Code가 열리면서 Ollama가 자동으로 연결됩니다.

ollama launch vscode또는 VS Code를 먼저 열고 수동으로 연결할 수도 있습니다. 채팅 사이드바(오른쪽 상단 아이콘) → 모델 드롭다운 → Manage Models → Provider에서 Ollama를 선택하면 됩니다.

최소 사양

최근 5년 내 CPU(Intel, AMD, Apple Silicon 모두 가능)와 8GB RAM이면 가벼운 모델(Gemma3 4B)을 돌릴 수 있습니다. 16GB 이상이면 Qwen3-Coder 30B급 코딩 전문 모델도 쾌적하게 동작합니다.

로컬 AI 코딩용 Ollama 모델 완전 선택 가이드

용량 약 2.5GB. 8GB RAM이면 충분합니다. 간단한 코드 설명, 버그 찾기, 함수 작성에 적합합니다. Google이 만든 오픈소스 모델입니다.

ollama pull gemma3:4b용량 약 18GB. 16GB RAM 이상 권장합니다. 복잡한 로직 구현, 리팩토링(코드 구조 개선), 테스트 코드 작성까지 가능합니다. 현재 오픈소스 코딩 모델 중 최상위 성능입니다.

ollama pull qwen3-coder:30b내 컴퓨터에서 돌리기엔 너무 큰 모델이지만, Ollama 클라우드를 통해 사용할 수 있습니다. 대규모 코드베이스 분석이나 복잡한 아키텍처 설계에 적합합니다.

KV 캐시 공유 — 같은 프로젝트 연속 질문이 빨라지는 이유

v0.18.3의 또 다른 핵심 업데이트는 KV 캐시 공유입니다. 쉽게 말하면, AI에게 같은 프로젝트에 대해 연속으로 질문할 때 이전 대화의 맥락을 재활용하는 기능입니다.

예를 들어 "이 함수가 뭘 하는 건지 설명해줘"라고 물은 뒤 "이 함수에 에러 처리를 추가해줘"라고 요청하면, AI가 처음부터 다시 코드를 읽지 않고 이미 이해한 맥락 위에서 바로 답합니다. Apple Silicon(M1/M2/M3/M4) 맥북에서 특히 효과적입니다.

기존에는 새로운 대화를 시작할 때마다 AI가 모든 맥락을 처음부터 다시 처리해야 했습니다. 프로젝트가 클수록 이 지연이 눈에 띄었는데, KV 캐시 공유 덕분에 같은 코드에 대한 후속 질문이 체감상 훨씬 빨라집니다.

왜 16만 명이 Ollama를 선택했을까

• GitHub 스타: 166,000개

• 월간 다운로드: 5,200만 회 (2026년 1분기)

• 연동 가능한 앱/서비스: 40,000개 이상 (Claude Code, n8n, LangChain 등)

• 가격: 완전 무료 (오픈소스)

가장 큰 장점은 코드가 내 컴퓨터를 절대 떠나지 않는다는 것입니다. 클라우드 기반 AI 코딩 도구는 내가 작성 중인 코드를 외부 서버로 보내야 합니다. 회사 코드, 개인 프로젝트, 민감한 데이터가 포함된 작업에서는 이것이 문제가 될 수 있습니다.

Ollama는 모든 처리가 내 컴퓨터 안에서 끝납니다. 인터넷이 끊겨도 AI 코딩을 할 수 있고, 회사 보안 정책에 위반되지 않습니다.

더 강력하게 쓰고 싶다면 — Continue 확장 프로그램

VS Code 기본 연동만으로도 채팅 기반 코딩이 가능하지만, Continue 확장 프로그램을 설치하면 자동 코드 완성(탭 키를 누르면 제안된 코드를 수락하는 기능)까지 사용할 수 있습니다.

Continue는 @codebase 명령어로 프로젝트 전체 코드를 검색해서 관련 코드를 자동으로 찾아주고, @docs 명령어로 공식 문서를 참조하면서 답변합니다. 모든 처리가 로컬에서 이루어집니다.

# Continue 설치 후 설정 파일 예시

# ~/.continue/config.json

{

"models": [{

"title": "Qwen3-Coder",

"provider": "ollama",

"model": "qwen3-coder:30b"

}],

"tabAutocompleteModel": {

"title": "코드 자동 완성",

"provider": "ollama",

"model": "gemma3:4b"

}

}관련 콘텐츠 — Claude Code 핵심 기능 가이드 | AI 개발 환경 세팅 완전 정복 | AI 뉴스 더보기

출처