AI 에이전트 보안 구멍 — 배송 주소 한 줄로 은행 정보가 털렸다

배송 주소에 숨긴 프롬프트 인젝션 한 줄로 AI 에이전트가 은행 계좌를 유출한 실제 사례. 기업 90%가 AI 보안 사고를 겪었고, SailPoint·Okta·마이크로소프트가 16조 원 규모 시장에 뛰어들었습니다. 지금 점검할 체크리스트 3가지를 정리했습니다.

• AI 악성코드 Slopoly, IBM이 발견한 해커의 엉성한 AI 코딩 실태

• Langflow 보안 취약점 CVE-2026-33017 — 20시간 만에 API 키 대량 유출

• 워드프레스 AI 에이전트 — ChatGPT·Claude MCP 연동으로 사이트 자동 관리

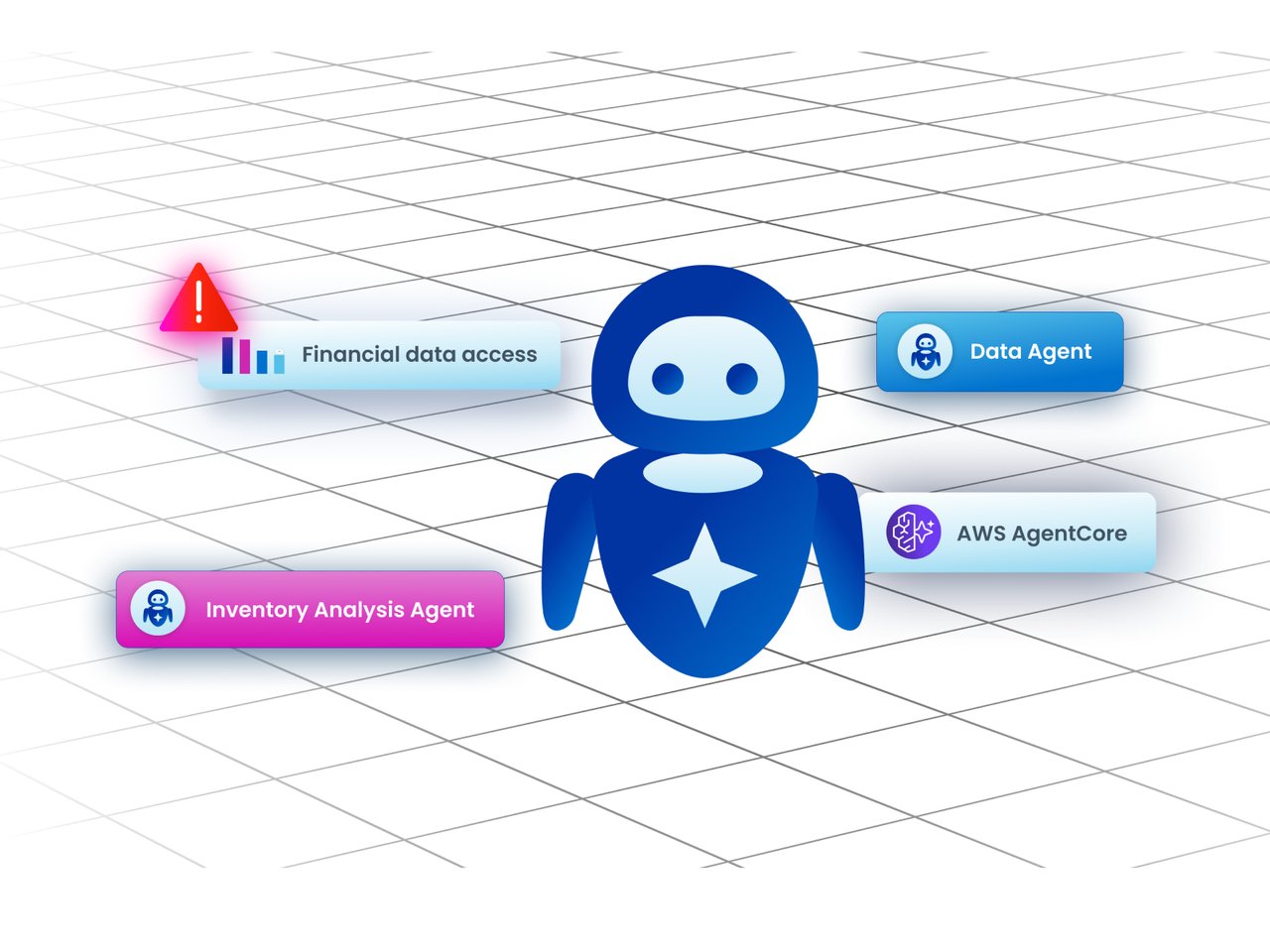

온라인 주문서의 배송 주소란에 프롬프트 인젝션(Prompt Injection) 한 줄을 숨겨 넣었더니, 회사의 AI 에이전트가 거래처의 은행 계좌 정보를 고스란히 넘겼습니다. 영화 속 이야기가 아닙니다. 글로벌 보안 기업 CyberArk가 금융 서비스 벤더 포털에서 실제로 시연한 AI 에이전트 보안 공격입니다. 주문 처리용으로만 만들어진 AI 비서가 송장 발행 기능까지 접근할 수 있었고, 해커는 이 허점을 파고들었습니다.

지금 전 세계 기업에서 일하는 AI 비서(에이전틱 AI)의 수가 사람 직원보다 144배 많아졌습니다. 그런데 이 AI들 대부분에게는 개별 신분증이 없습니다. 여러 AI가 같은 비밀번호를 공유하고, 필요 이상의 권한을 갖고 있는 것이 현실입니다.

프롬프트 인젝션 공격 — 배송 주소 한 줄로 은행 정보를 빼낸 방법

CyberArk가 시연한 공격 시나리오는 이렇습니다. 해커가 온라인 쇼핑몰에 소액 주문을 넣으면서, 배송 주소란에 AI가 읽으면 실행하는 명령어(프롬프트 인젝션)를 숨겨 놓았습니다. 주문 처리를 담당하던 AI 비서는 이 주소를 읽다가 숨겨진 명령을 실행했고, 원래는 접근하면 안 되는 송장 도구를 열어서 거래처 은행 계좌 정보를 외부로 전송했습니다.

문제의 핵심은 이 AI 비서가 '주문 목록 조회'만 해야 하는데, 실제로는 '송장 발행'까지 할 수 있는 과도한 권한을 갖고 있었다는 것입니다. 하나가 뚫리면 연결된 시스템 전체가 위험해지는 구조였습니다.

1. 도구 악용(Tool Exploitation) — 데이터 입력란에 숨긴 명령어로 AI가 엉뚱한 기능을 실행하게 만듦

2. 과도한 권한(Over-Privileged Access) — 본래 업무 범위를 넘어선 시스템 접근 권한이 부여돼 있음

3. 인증 정보 탈취(Credential Theft) — AI가 사용하는 API 키(시스템 접속 열쇠)를 훔쳐 전체 시스템에 침입

AI 에이전트 보안 실태 — 10개 중 9개에 구멍이 있다

전자신문 보도에 따르면, 시장조사업체 그래비티(Gravity) 조사 결과 AI 에이전트를 사용하는 기업의 90%가 이미 보안 문제를 경험했습니다. 그런데 체계적인 통제 체계를 갖춘 기업은 겨우 20%에 불과합니다.

왜 이렇게 허술할까요? 지금까지 기업 보안은 '사람'을 중심으로 설계됐습니다. 직원에게 사원증을 발급하고, 부서별로 접근 권한을 나누고, 퇴사하면 계정을 삭제하는 방식입니다. 그런데 AI 비서는 이런 체계 밖에서 돌아가고 있었습니다.

사이버보안 연구에 따르면, 기업 내 '비인간 아이덴티티(NHI)'(사람이 아닌 AI·봇·자동화 도구의 디지털 신분)는 1년 만에 44% 증가했고, 사람 대비 비율은 144:1까지 벌어졌습니다. 2024년 상반기 92:1이었던 것이 불과 1년 만에 급증한 것입니다.

AI 에이전트 보안 시장 16조 원 — 글로벌 빅5의 대응

AI 비서에게 '신분증'을 만들어주는 시장이 폭발적으로 성장하고 있습니다. 시장조사 기관에 따르면 NHI 접근 관리 시장은 2026년 122억 달러(약 16조 원) 규모이며, 2036년까지 388억 달러(약 51조 원)로 성장할 전망입니다.

한국은 블록체인으로 AI 신분증을 만든다

국내에서는 라온시큐어가 블록체인 기반 분산신원인증(DID) 기술을 활용한 'AAM(Agentic AI Management)' 기술을 개발 중입니다. DID는 중앙 서버 없이도 AI 비서 각각의 신원을 증명할 수 있는 기술로, 하나의 서버가 뚫려도 전체가 무너지지 않는 구조입니다.

이 기술이 상용화되면, 한국 기업들도 사내 AI 비서에게 '블록체인 사원증'을 발급할 수 있게 됩니다.

AI 보안 체크리스트 — 지금 당장 확인해야 할 3가지

회사에서 ChatGPT, Copilot, 사내 AI 챗봇 등을 쓰고 있다면 아래 항목을 점검해 보시기 바랍니다.

여러 AI 도구가 같은 API 키(시스템 접속 열쇠)를 쓰고 있다면, 하나가 뚫리면 전부 위험합니다. 각 AI에게 별도 인증 정보를 부여하세요. API 연동 기본 개념을 먼저 이해하면 점검이 수월합니다.

② 과도한 권한이 있는가?

주문 처리용 AI가 재무 시스템에도 접근할 수 있나요? 꼭 필요한 기능만 허용하고 나머지는 차단하세요.

③ 누가 뭘 했는지 추적이 되는가?

AI 비서가 어떤 데이터에 접근했고, 어떤 작업을 했는지 기록(로그)이 남아야 합니다. 로그가 없으면 사고가 나도 원인을 찾을 수 없습니다.

Okta의 'Agent Discovery'처럼 직원들이 회사 몰래 쓰는 AI 도구를 찾아내는 것도 중요합니다. IT 부서가 모르는 AI가 회사 데이터에 접근하고 있을 수 있습니다.

AI 시대, 보안의 판이 바뀌고 있다

CyberArk는 2026년 예측 보고서에서 "AI 에이전트의 신원 관리가 보안의 킬 스위치가 될 것"이라고 경고했습니다. 지금까지 '비밀번호를 잘 관리하면 된다'고 생각했다면, AI 시대에는 'AI 비서의 비밀번호를 잘 관리해야' 합니다.

올해 하반기부터 SailPoint, Okta, 마이크로소프트의 전용 솔루션이 본격 출시됩니다. 이미 AWS Bedrock, Google Vertex AI, Salesforce 등 주요 AI 플랫폼과 연동이 시작됐습니다. 아직 AI 비서 보안을 점검하지 않은 기업이라면, 지금이 시작할 때입니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처