Langflow 보안 취약점 CVE-2026-33017 — 공개 20시간 만에 API 키 대량 유출

깃허브 스타 14.6만 AI 노코드 빌더 Langflow에서 심각도 9.3점 취약점 발견. 보안 공지 20시간 만에 OpenAI·Anthropic·AWS API 키가 실제 유출됐습니다. 즉시 업데이트 방법과 피해 확인 체크리스트를 정리했습니다.

• 해커가 AI로 악성코드를 만들었는데 코드에 버그가 너무 많았습니다 — IBM이 발견한 Slopoly

• 내 맥북이 AI 보안 카메라가 됐다 — 월 구독료 0원에 정확도 93.8%, 오픈소스 SharpAI

• 'AWS 구조도 그려와' 한마디면 AI가 draw.io에 완성합니다 — 깃허브 스타 2만 3천

AI 노코드 자동화 도구 Langflow에서 심각도 9.3점의 보안 취약점(CVE-2026-33017)이 발견됐습니다. 깃허브 스타 14만 6천 개를 받은 이 인기 AI 워크플로우 빌더의 보안 공지가 나온 지 20시간 만에 해커들이 실제 공격을 시작했고, 사용자들의 OpenAI, Anthropic, AWS API 키가 유출됐습니다. Langflow 사용자라면 지금 바로 확인해야 합니다.

Langflow란? AI 노코드 자동화 플랫폼

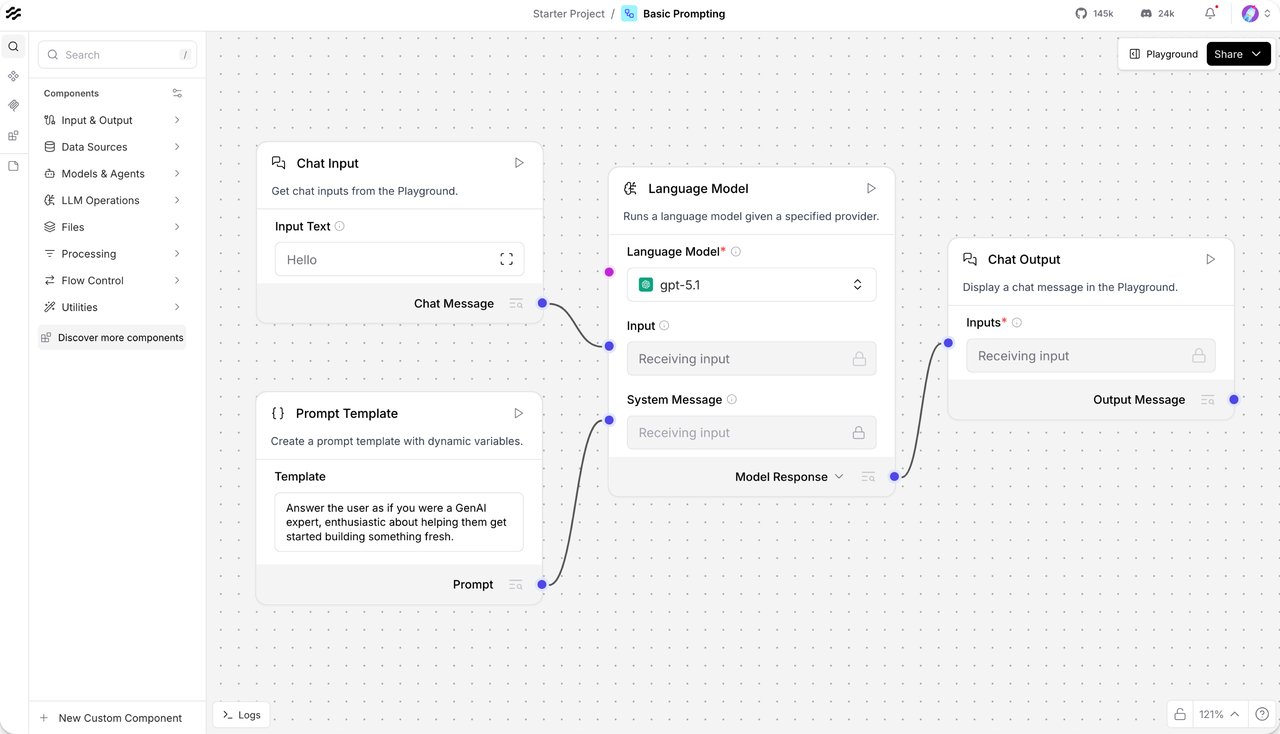

Langflow는 블록을 끌어다 놓는 것만으로 AI 챗봇, 문서 분석기, 콘텐츠 생성기 같은 AI 자동화 도구를 만들 수 있는 노코드 플랫폼입니다. 코딩을 몰라도 AI 앱을 만들 수 있어서 개발자뿐 아니라 마케터, 데이터 분석가도 많이 사용합니다. 외부 AI 서비스와 API를 연동해서 다양한 자동화 파이프라인을 구성할 수 있는 것이 핵심 기능입니다.

Langflow의 비주얼 에디터. 블록을 끌어다 연결하면 AI 자동화가 만들어진다.

CVE-2026-33017 취약점 — 발견부터 해킹까지 공격 타임라인

보안 연구원 Aviral Srivastava가 2월 26일에 발견하고 신고한 이 취약점(CVE-2026-33017)은 심각도 10점 만점에 9.3점을 받았습니다. 보안 등급으로는 '치명적(Critical)'입니다.

- 3월 17일 20:05 UTC — 보안 공지 공개

- 3월 18일 16:04 UTC — 첫 번째 공격 시도 감지 (공개 후 20시간)

- 3월 18일 16:39 UTC — 여러 서버에서 동시 스캔 시작

- 3월 18일 20:55 UTC — 대규모 비밀번호·API 키 탈취 작전 돌입

놀라운 점은 당시 공개된 공격 코드(PoC)가 없었다는 것입니다. 해커들은 보안 공지의 설명만 읽고 직접 공격 도구를 만들어냈습니다.

해커가 탈취한 API 키와 민감 정보

보안 기업 Sysdig의 위협 연구팀이 추적한 결과, 공격자들은 다음 정보를 빼갔습니다:

- OpenAI API 키 — ChatGPT, GPT-4 등을 호출하는 데 쓰는 비밀번호

- Anthropic API 키 — Claude를 호출하는 데 쓰는 비밀번호

- AWS 접근 자격증명 — 클라우드 서버, 데이터베이스 접근 권한

- 데이터베이스 연결 정보

- .env 설정 파일 — 각종 비밀 정보가 모여 있는 파일

이 키들이 유출되면, 해커가 내 돈으로 AI를 사용하거나 내 데이터베이스에 접근할 수 있습니다. 실제로 독일, 싱가포르, 프랑스, 네덜란드 등 6개국에서 동시에 공격이 들어왔습니다.

Langflow AI 보안 취약점이 특히 위험한 3가지 이유

이 취약점이 특별히 위험한 이유는 세 가지입니다:

참고로 Langflow는 이전에도 비슷한 취약점(CVE-2025-3248, 심각도 9.8점)이 발견된 적 있습니다. 코드 실행 경로에 대한 입력 검증이 구조적으로 부족한 패턴이 반복되고 있습니다.

Langflow 사용자라면 지금 당장 해야 할 일

1.8.1 이하 버전을 쓰고 있다면 즉시 업데이트해야 합니다:

# Langflow 최신 버전으로 업데이트

pip install langflow --upgrade

# 현재 버전 확인

langflow --version업데이트 외에도 다음 조치를 권장합니다:

- API 키 즉시 교체 — OpenAI, Anthropic, AWS 등 연결된 모든 서비스의 키를 새로 발급받으세요

- 인터넷에 직접 노출하지 마세요 — 방화벽이나 VPN 뒤에 배치하세요

- 이상한 외부 연결 확인 — 서버 로그에서 oastify.com, interact.sh 등으로의 연결이 있는지 점검하세요

AI 자동화 도구 보안 취약점이 반복되는 이유

이번 사건은 AI 도구들의 보안이 얼마나 취약한지 다시 한번 보여줍니다. Langflow처럼 AI 모델과 연결되는 도구들은 OpenAI, Anthropic, AWS 같은 서비스의 API 키를 저장하고 있어서, 하나가 뚫리면 연결된 모든 서비스가 위험해집니다.

지난주에도 Snowflake의 AI 기능에서 데이터베이스를 삭제할 수 있는 보안 구멍이 발견된 바 있습니다. AI 도구를 사용할 때는 어떤 권한을 주고 있는지, 인터넷에 노출돼 있는지를 반드시 확인해야 합니다. AI 자동화 도구를 안전하게 활용하려면 프로젝트 구조와 보안 설정의 기본부터 이해하는 것이 중요합니다.

Langflow의 플레이그라운드 화면. 이런 인터페이스 뒤에서 API 키가 저장·사용된다.

자주 묻는 질문

Langflow를 로컬에서만 쓰면 안전한가요?

외부 네트워크에 노출되지 않았다면 직접 해킹당할 위험은 낮습니다. 하지만 같은 네트워크 내 다른 기기가 감염된 경우 내부 공격이 가능하므로, 최신 버전으로 업데이트하는 것을 권장합니다. 로컬 환경이라도 API 키는 환경 변수로 분리 관리하세요.

API 키가 유출됐는지 어떻게 확인하나요?

서버 로그에서 /api/v1/validate/code 엔드포인트로의 비정상적인 POST 요청을 확인하세요. oastify.com, interact.sh 등 외부 도메인으로의 DNS 요청이 있었다면 공격을 받았을 가능성이 높습니다. OpenAI, Anthropic, AWS 각 서비스의 사용량 대시보드에서 본인이 사용하지 않은 비정상 호출이 없는지도 점검하세요.

AI 자동화 도구를 안전하게 쓰는 방법은?

어떤 AI 도구든 인터넷에 직접 노출하지 말고 방화벽이나 VPN 뒤에 배치하세요. API 키는 환경 변수로 관리하고 주기적으로 교체해야 합니다. AI 도구를 외부 서비스와 연결할 때는 MCP 연동의 보안 원칙을 이해하고, 최소한의 권한만 부여하는 것이 핵심입니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처