내가 쓰는 AI가 거짓말하는 건 버그가 아니라 구조였다 — 수학으로 증명됐습니다

AI 환각 현상은 모델을 키워도 해결되지 않는 구조적 한계라는 수학적 증명이 나왔습니다. 논문이 제시하는 해결책은 '개념 기반 접근법'입니다.

ChatGPT에게 질문했는데 그럴듯하지만 완전히 틀린 답을 받아본 적 있습니까? AI 연구자 그레고리 코폴라(Gregory Coppola)가 3월 17일 발표한 논문에서 그 원인을 수학적으로 증명했습니다. 결론은 충격적입니다 — AI의 거짓말은 고칠 수 있는 버그가 아니라, 구조 자체에서 비롯된 필연적 결과라는 것입니다.

"환각(AI가 사실이 아닌 내용을 자신 있게 말하는 현상)은 스케일링으로 고칠 수 있는 버그가 아니다. 개념 없이 작동하는 것의 구조적 결과다." 논문의 핵심 주장입니다.

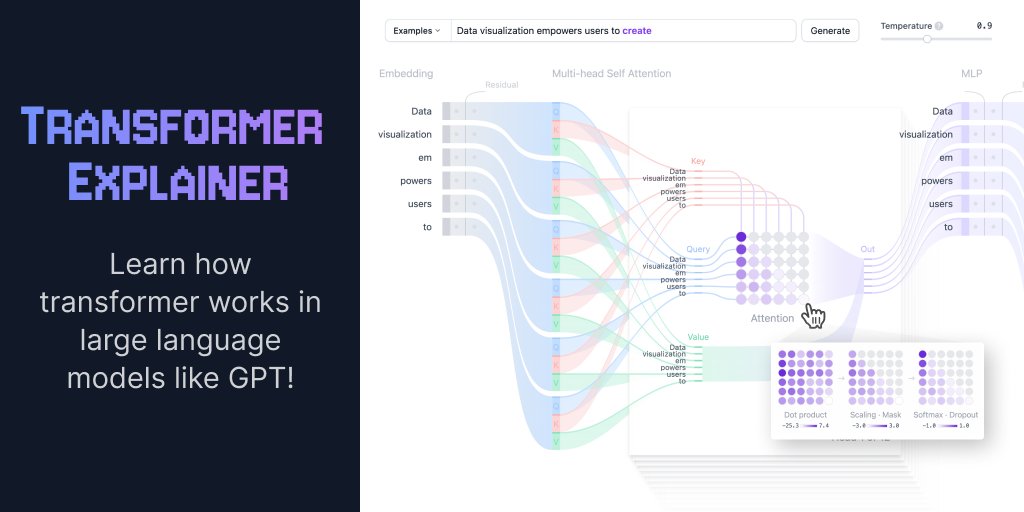

Transformer(AI의 핵심 엔진) 내부 구조를 시각화한 Georgia Tech의 교육용 도구. 이 논문은 이 구조가 수학적으로 베이지안 네트워크와 동일하다는 것을 증명했습니다.

AI의 두뇌는 사실 '확률 추론 기계'였다

논문의 첫 번째 발견은 이것입니다: 트랜스포머(ChatGPT·Claude·Gemini 등 모든 AI의 핵심 엔진)는 수학적으로 베이지안 네트워크(확률을 계산해서 추론하는 수학적 모델)와 완전히 동일한 구조라는 것입니다.

쉽게 말하면, AI가 문장을 만들 때 실제로 하는 일은 "이 단어 다음에 올 확률이 가장 높은 단어는 뭘까?"를 반복 계산하는 것인데, 이 계산 과정이 수학자들이 200년 전부터 써온 확률 추론 방법과 정확히 같다는 뜻입니다.

구체적으로:

• 어텐션(Attention) — AI가 문장에서 관련 있는 단어들을 찾아보는 과정 → 수학적으로는 "이웃 노드의 정보를 수집하는 것"과 동일

• 피드포워드 네트워크(FFN) — 수집한 정보를 종합해서 결론을 내리는 과정 → 수학적으로는 "조건부 확률을 계산하는 것"과 동일

• 레이어 하나 = 확률 추론 한 라운드. GPT-4의 레이어가 100개 이상이면, 확률 추론을 100번 이상 반복하는 것입니다.

왜 모델을 아무리 키워도 거짓말이 사라지지 않는가

여기서 핵심적인 질문이 나옵니다. 확률 추론을 정확히 하고 있는데, 왜 AI는 여전히 거짓말을 할까요?

코폴라의 답은 이렇습니다: "사실"이 뭔지 정의할 기준 자체가 없기 때문입니다.

현재 ChatGPT나 Claude 같은 AI는 인터넷에서 읽은 수조 개의 문장을 바탕으로 "다음 단어"를 예측합니다. 하지만 이 과정에서 "이것은 사실이다" "이것은 거짓이다"를 판별하는 기준표가 없습니다. 논문의 표현을 빌리면, "검증 도구가 없는 언어 모델은 유한한 개념 공간이 없고, 따라서 출력이 맞는지 틀리는지 자체가 정의되지 않는다"는 것입니다.

이것은 단순히 데이터가 부족해서가 아닙니다. 파라미터를 10배, 100배로 늘려도 해결되지 않는 구조적 한계라는 것이 이 논문의 수학적 결론입니다. 모델이 커지면 문장은 더 유창해지지만, "사실 확인" 메커니즘이 없다면 더 유창한 거짓말을 하게 될 뿐입니다.

해결책은 있다 — AI에게 '사실 확인 기준표'를 주면 된다

다행히 논문은 해결 방향도 제시합니다. 핵심은 "그라운딩(grounding)" — AI에게 명확한 사실 기준표를 제공하는 것입니다.

논문의 정리 7.4(Corollary 7.4)에 따르면, 트리 구조(순환이 없는 구조)의 지식 베이스에 연결된 트랜스포머는 수학적으로 환각이 불가능합니다. "확률 추론 알고리즘의 가중치가 정확하고, 지식이 트리 구조로 정리되어 있으면, 세 가지 환각 조건(잘못된 가중치, 잘못된 경로, 기준 부재) 중 어느 것도 성립하지 않는다"는 것입니다.

실험도 이를 뒷받침합니다. 논문에서 구현한 트랜스포머와 정확한 확률 추론의 오차는 최대 0.0023에 불과했습니다. 소수점 셋째 자리까지 일치한 것입니다.

한 줄 요약: 현재 AI는 "유창한 문장 생성기"이지 "사실 확인 기계"가 아닙니다. 사실 확인 기계로 만들려면, AI에게 "이것은 참이다/거짓이다"를 판별할 수 있는 명확한 지식 체계를 별도로 제공해야 합니다.

ChatGPT·Claude 사용자가 지금 할 수 있는 것

이 논문이 당장 AI 사용법을 바꾸지는 않습니다. 하지만 AI를 대하는 마음가짐은 바꿔야 합니다:

1. AI의 답변을 "검색 결과"처럼 무조건 믿지 마십시오. AI는 "가장 그럴듯한 다음 단어"를 출력할 뿐, "사실"을 출력하는 것이 아닙니다.

2. 중요한 의사결정에 AI를 쓸 때는 반드시 출처를 확인하십시오. ChatGPT 답변만 믿고 3250억 원 소송에서 진 CEO의 사례가 이를 잘 보여줍니다.

3. AI 회사가 "환각 문제를 해결했다"고 광고할 때 비판적으로 보십시오. 이 논문에 따르면, 구조를 근본적으로 바꾸지 않는 한 환각은 줄일 수는 있지만 없앨 수는 없습니다.

앞으로 AI는 어떻게 바뀔까

이 논문의 방향이 맞다면, 미래의 AI는 두 가지로 나뉠 수 있습니다. 하나는 지금처럼 자유롭게 대화하는 "창의적 AI"이고, 다른 하나는 검증된 지식 베이스에 연결된 "신뢰할 수 있는 AI"입니다. 의료 진단, 법률 자문, 재무 분석처럼 정확성이 생명인 분야에서는 후자가 필수적일 것입니다.

논문 저자 코폴라는 독립 연구자로, 멕시코에서 coppola.ai를 운영하며 논리적 베이지안 네트워크 연구를 이어오고 있습니다. 이전 논문 QBBN(Quantified Boolean Bayesian Network)에서 이미 이 아이디어의 기초를 제시한 바 있습니다.

전체 논문은 arXiv에서 무료로 읽을 수 있으며, 구현 코드는 GitHub에 공개되어 있습니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처