AI에게 처음 보는 게임을 시켰더니 사람은 100점, AI는 12점입니다 — 상금 11억 ARC-AGI-3

AI 벤치마크의 판이 바뀌었습니다. ARC-AGI-3는 기존 '정답 맞추기' 대신 '처음 보는 게임을 스스로 풀기'를 요구합니다. 사람은 100점인데 최고 AI는 12점, GPT-5급은 1점도 못 받았습니다. 총 상금 11억 원, 지금 참여할 수 있습니다.

AI의 진짜 실력을 측정하는 방법이 완전히 달라졌습니다. 2026년 3월 25일 공개된 ARC-AGI-3는 AI에게 규칙도 목표도 알려주지 않은 채 처음 보는 게임을 풀도록 시키는 세계 최초의 인터랙티브 추론 벤치마크입니다. 결과는 충격적입니다 — 사람은 100점인데 가장 잘한 AI가 12.58점, GPT-5급 대형 언어 모델은 1점도 못 받았습니다. 총 상금 약 11억 원(85만 달러), 대상만 9억 원(70만 달러)입니다.

기존 AI 시험과 완전히 다릅니다

지금까지의 AI 벤치마크는 대부분 '정답 맞추기'였습니다. 수학 문제를 풀거나, 코드를 작성하거나, 이미지 속 패턴을 찾는 식이었습니다. ARC-AGI의 이전 버전(1, 2)도 '그리드 위에서 패턴을 찾아 변환하라'는 정적 퍼즐이었습니다.

ARC-AGI-3는 근본적으로 다릅니다. AI를 비디오 게임 같은 환경에 던져 놓고 아무것도 알려주지 않습니다.

ARC-AGI-3에서 AI가 해야 하는 일

1. 화면을 보고 무엇이 중요한지 스스로 파악

2. 여러 행동을 시도하며 규칙을 추론

3. 어떤 상태가 목표인지 스스로 판단

4. 실패에서 배워 전략을 수정

설명서도 없고, 힌트도 없고, 목표가 뭔지조차 알려주지 않습니다. 150개 이상의 환경, 1,000개 이상의 레벨이 있습니다.

쉽게 말하면 이런 상황입니다. 여러분이 한 번도 해본 적 없는 보드게임 앞에 앉았는데, 규칙서가 없습니다. 주사위를 굴려보고, 말을 옮겨보면서 '아, 이렇게 하는 거구나'를 알아내야 합니다. 사람은 이걸 자연스럽게 합니다. AI는 못 합니다.

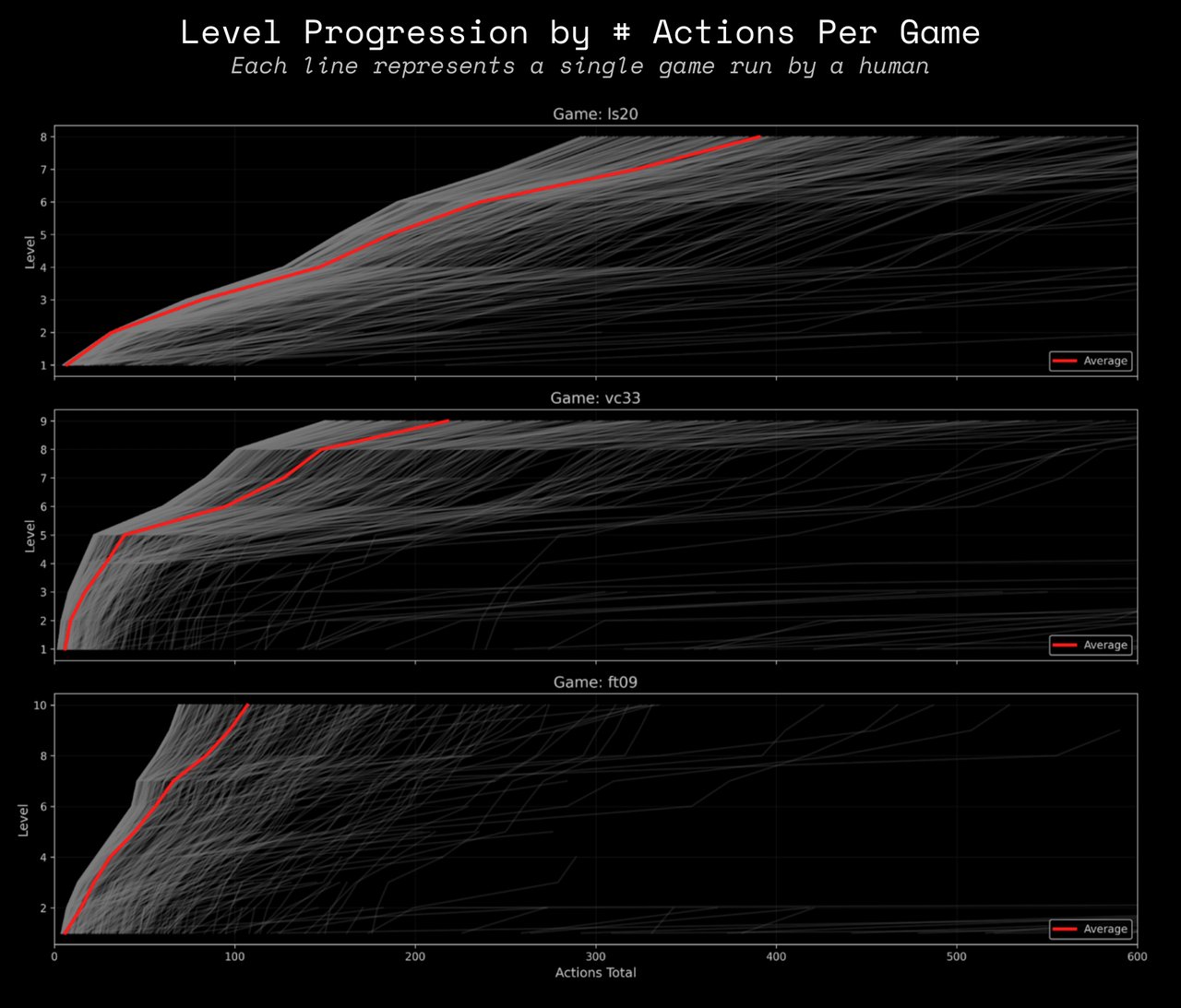

성적표: 사람 100점, 최고 AI 12점

30일간의 프리뷰 기간 동안 인간 1,200명 이상이 3,900번 넘게 플레이하여 기준 점수를 만들었습니다. 100점은 인간과 동일한 효율로 게임을 클리어했다는 뜻입니다.

AI의 성적은 이렇습니다.

가장 놀라운 점은, 우리가 '가장 똑똑하다'고 생각하는 ChatGPT나 Claude 같은 대형 언어 모델(LLM)이 가장 낮은 점수를 받았다는 것입니다. 1등을 차지한 건 CNN(이미지를 인식하는 AI 모델)과 강화학습(시행착오를 반복하며 배우는 방식)을 결합한 시스템이었습니다. 대화에 능숙한 AI와 새로운 환경에서 배우는 AI는 완전히 다른 능력인 셈입니다.

시각 입력을 주면 점수가 97배 올랐습니다

해커뉴스 토론(371표, 248개 댓글)에서 흥미로운 사실이 나왔습니다. Anthropic의 Opus 모델에게 게임 화면을 '볼 수 있게' 해줬더니 점수가 0%에서 97.1%로 뛰었다는 것입니다. '눈'이 있느냐 없느냐가 결정적 차이였습니다. 이는 현재 AI의 약점이 '지능' 자체가 아니라 '감각과 학습의 결합'에 있다는 것을 보여줍니다.

상금 11억 원 — 지금 참여할 수 있습니다

ARC Prize 2026 대회는 총 상금 약 200만 달러(약 26억 원) 규모이며, ARC-AGI-3 트랙만 85만 달러(약 11억 원)입니다.

대상(100% 달성): 70만 달러 (약 9.1억 원) — 미달성 시 다음 해로 이월

1등: 4만 달러 | 2등: 1.5만 달러 | 3~5등: 각 5천~1만 달러

중간 마일스톤(6/30, 9/30): 각 3.75만 달러

참여 방법은 간단합니다. Python이 설치되어 있다면 터미널에서 바로 시작할 수 있습니다.

# ARC-AGI-3 도구 설치

pip install arc-agi

# 또는 uv 사용자라면

uv add arc-agiAnthropic, OpenAI, Google, HuggingFace 등 주요 AI 플랫폼의 에이전트 템플릿이 제공되어, 자신이 쓰는 AI 모델로 바로 도전할 수 있습니다.

핵심 규칙 3가지

1. 오픈소스 필수 — 모든 해법은 MIT 또는 CC0 라이선스로 공개해야 합니다

2. 인터넷 없이 평가 — Kaggle에서 오프라인으로 실행되므로 ChatGPT API 호출이 불가능합니다

3. 효율이 곧 점수 — 게임을 클리어하는 것만이 아니라, 얼마나 적은 행동으로 해결했느냐가 점수입니다

주요 일정

마일스톤 1: 2026년 6월 30일 | 마일스톤 2: 2026년 9월 30일 | 제출 마감: 2026년 11월 2일 | 결과 발표: 2026년 12월 4일

왜 이 벤치마크가 중요한지

ARC-AGI-3를 만든 프랑수아 숄레(François Chollet)는 딥러닝 프레임워크 Keras(케라스)의 창시자이자, '지능의 측정' 분야에서 가장 영향력 있는 연구자 중 한 명입니다. 그는 이렇게 말했습니다.

"AI와 인간의 학습 능력 사이에 격차가 존재하는 한, 우리는 AGI(범용 인공지능)를 가지고 있지 않은 것입니다."

이번 벤치마크가 AI 업계에 던지는 메시지는 명확합니다. ChatGPT가 아무리 대화를 잘 하고, Claude가 아무리 코드를 잘 짜도, '처음 보는 상황에서 배우는 능력'은 아직 갓난아이 수준이라는 것입니다.

그리고 이 격차를 줄이는 데 성공하는 팀에게는 9억 원이 기다리고 있습니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처