Claude 군사 AI 첫 실전 투입 — 이란전 24시간, 표적 1,000개 자동 선별

매일 쓰는 Claude가 이란전에서 폭격 표적을 골랐습니다. 첫 24시간 1,000개 표적 자동 선별 — AI가 결정하고 사람은 승인만 하는 전쟁 시대의 시작. 한국 국방AI법 대응까지 분석합니다.

• OpenAI 8000명 대규모 채용 — ChatGPT vs Anthropic 기업 AI 시장 경쟁 분석

• AI 딥페이크 인플루언서 60개 적발 — 3주 만에 팔로워 300만의 비밀

• AI 프로파일링 — 온라인 댓글 1,000개로 직업·성격·취미까지 전부 맞힌다

여러분이 매일 질문을 하고, 코드를 짜고, 보고서를 쓰는 데 쓰는 AI — Anthropic의 Claude. 바로 그 Claude가 이란전 전쟁터에서 폭격 대상을 골라내는 '전장의 두뇌'로 투입됐습니다. 전자신문이 23일 보도한 바에 따르면, Claude가 탑재된 미 국방부 군사 AI 시스템이 전쟁 첫 24시간 동안 약 1,000개 표적을 선별하고, 공격 우선순위까지 자동으로 정했습니다.

이것은 단순한 기술 뉴스가 아닙니다. '사람이 판단하고 AI가 돕는' 시대에서, 'AI가 판단하고 사람이 승인하는' 시대로 전환된 역사적 첫 사례입니다.

첫 24시간, 1,000개 표적 — Claude 군사 AI가 전쟁터에서 한 일

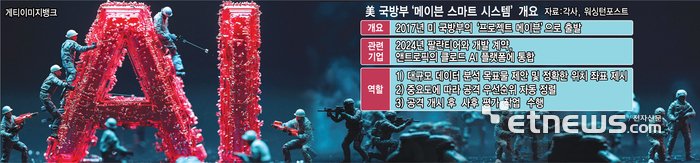

미 국방부는 이란전에 메이븐 스마트 시스템(Maven Smart System, 군사 정보를 AI로 분석하는 플랫폼)을 실전 투입했습니다. 이 시스템의 핵심 엔진이 바로 Anthropic의 대규모 언어 모델 Claude입니다.

Claude가 탑재된 이 시스템이 전쟁터에서 수행한 작업은 다음과 같습니다:

① 정보 수집 — 위성·감시 장비에서 수집된 방대한 기밀 데이터를 분석

② 표적 제안 — 수백 개의 목표물을 자동 식별하고 정확한 위치 좌표 제시

③ 우선순위 정렬 — 중요도에 따라 공격 순서를 자동으로 결정

④ 사후 평가 — 공격 후 타격 효과를 AI가 직접 평가

전쟁 첫 24시간 동안 이 시스템은 약 1,000개 표적을 선별했습니다. 기존에 군사 분석관 수천 명이 며칠에 걸쳐 수행하던 작업을 AI가 몇 시간 만에 해낸 것입니다.

'사람이 결정하는 전쟁'에서 'AI가 결정하는 전쟁'으로

이번 사례의 핵심은 의사결정 구조의 근본적인 변화입니다.

곽기호 국방과학연구소 국방인공지능기술연구원장은 이렇게 설명했습니다:

"의사결정 과정에 인간이 관여하는 '휴먼 인 더 루프' 단계를 넘어서, AI가 모든 결정을 하고 인간의 판단만 기다리는 '휴먼 온 더 루프' 구조로 전환됐습니다."

쉽게 풀어서 설명하면 이렇습니다:

이전 — '사람이 운전하는 차'

사람이 데이터를 보고 → 직접 판단하고 → AI에게 실행을 지시

현재 — '자율주행차에 탄 사람'

AI가 데이터를 보고 → 최적안을 판단하고 → 사람에게 '승인 버튼'을 보여줌

이처럼 AI가 자율적으로 판단하고 행동하는 구조를 에이전틱 AI(Agentic AI)라고 부릅니다. 군사 분야에서 이 개념이 현실이 된 첫 사례입니다.

문제는 AI가 수만 개의 데이터를 초 단위로 분석해 '최적의 타격안'을 제시할 때, 인간이 이를 충분히 검토할 시간이 있느냐입니다. 전쟁의 속도가 AI의 속도로 바뀌는 순간, 사람의 최종 승인은 형식적인 '확인 버튼 누르기'로 전락할 위험이 있습니다.

해킹보다 위험한 새로운 위협 — AI 학습 데이터 오염

군 관계자에 따르면, 현재 한국군의 K-RMF(한국형 위험관리체계, 정보시스템의 보안을 검증하는 국방 제도)는 기존 IT 해킹에 초점이 맞춰져 있습니다. 하지만 AI 시스템에는 완전히 다른 유형의 위협이 존재합니다:

🔴 학습 데이터 오염 — 적이 의도적으로 잘못된 데이터를 심어 AI의 판단을 왜곡합니다. 예를 들어, 병원을 군사 시설로 인식하게 만들 수 있습니다.

🔴 편향된 학습 — 특정 유형의 표적을 과대 또는 과소 평가하도록 AI를 유도합니다.

🔴 모델 조작 — AI 모델 자체를 변조하여 의도된 오류를 발생시킵니다. 기존 방화벽이나 암호화로는 막을 수 없는 공격입니다.

이런 AI 고유의 위협을 기존 보안 체계로는 탐지할 수 없다는 것이 전문가들의 공통된 우려입니다.

한국도 움직인다 — 여야가 손잡고 'AI 국방법' 만든다

이 상황에 한국 국회도 대응에 나섰습니다:

📅 2026년 4월 1일 — '이란전으로 본 AI 전쟁: 국방 혁신과 생명 윤리' 주제의 긴급 토론회 개최 예정

📋 초당적 입법 — 부승찬 의원(더불어민주당)과 유용원 의원(국민의힘)이 '국방AI기본법'을 공동 발의. AI의 군사적 활용 범위, 인간 통제권, 윤리 기준을 법으로 정하려는 시도입니다.

Anthropic도 올해 3월 5일 다리오 아모데이 CEO 명의로 '국방부와의 관계에 대한 현황'이라는 성명을 발표한 바 있습니다. AI를 만든 회사조차 군사 사용의 경계선을 어디에 그어야 할지 고민하고 있다는 뜻입니다.

같은 Claude, 다른 쓰임 — AI 윤리 논쟁의 시작

우리가 "이메일 초안 써줘"라고 말하는 Claude와, 전쟁터에서 "이 지역을 타격하시겠습니까?"라고 묻는 Claude는 같은 AI 모델입니다. 차이는 어떤 데이터를 보느냐, 어떤 목적으로 쓰느냐뿐입니다.

이번 사례는 AI 기술이 '도구일 뿐'이라는 인식에 근본적인 질문을 던집니다. 보고서를 쓰는 데도, 폭격 대상을 고르는 데도 쓸 수 있는 기술 — 그 경계를 누가, 어떻게 그어야 할까요?

전자신문은 이 기사를 '국방 AX 골든타임' 시리즈 1편으로 발행했습니다. 후속 보도에서 한국군의 AI 전략과 대응 방안이 다뤄질 예정입니다.

관련 콘텐츠 — 에이전틱 AI 개념 알아보기 | Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기