내 컴퓨터에 AI를 파일 하나로 심는다 — 10개월 만에 부활한 Mozilla Llamafile

Mozilla의 Llamafile이 10개월 침묵을 깨고 0.10 버전을 발표했습니다. 파일 하나만 더블클릭하면 윈도우·맥·리눅스 어디서든 AI가 실행됩니다. 파이썬도 도커도 필요 없습니다.

파이썬을 설치할 필요도, 도커를 띄울 필요도, 복잡한 설정 파일을 만들 필요도 없습니다. 파일 하나를 다운받아 더블클릭하면 내 컴퓨터에서 AI가 바로 실행됩니다. Mozilla가 만든 오픈소스 프로젝트 Llamafile이 10개월간의 침묵을 깨고 대규모 업데이트 v0.10을 발표했습니다. 깃허브 스타 2만 3,800개를 보유한 이 프로젝트는 '세상에서 가장 쉽게 AI를 실행하는 방법'을 목표로 합니다.

Llamafile이 뭔가요?

Llamafile은 AI 모델(LLM)을 하나의 실행 파일로 만들어주는 도구입니다. 보통 AI를 내 컴퓨터에서 돌리려면 파이썬 환경 설정, 라이브러리 설치, 모델 다운로드, 설정 파일 작성 등 여러 단계를 거쳐야 합니다. Llamafile은 이 모든 것을 파일 하나에 통째로 담습니다.

핵심 원리는 간단합니다. AI 추론 엔진인 llama.cpp와, 하나의 프로그램이 윈도우·맥·리눅스 등 6개 운영체제에서 모두 돌아가게 해주는 Cosmopolitan Libc를 합쳤습니다. 결과물은 1.6GB~19GB짜리 파일 하나이고, 이 파일만 있으면 어떤 컴퓨터에서든 AI와 대화할 수 있습니다.

10개월 만의 부활 — 0.10에서 뭐가 달라졌나

지난 v0.9.3(2025년 5월) 이후 업데이트가 없어서 "Mozilla가 또 프로젝트를 죽이는 거 아니냐"는 우려가 커지고 있었습니다. 이번 v0.10은 그 침묵을 깨는 구조적 대변신입니다.

핵심 변경사항 5가지

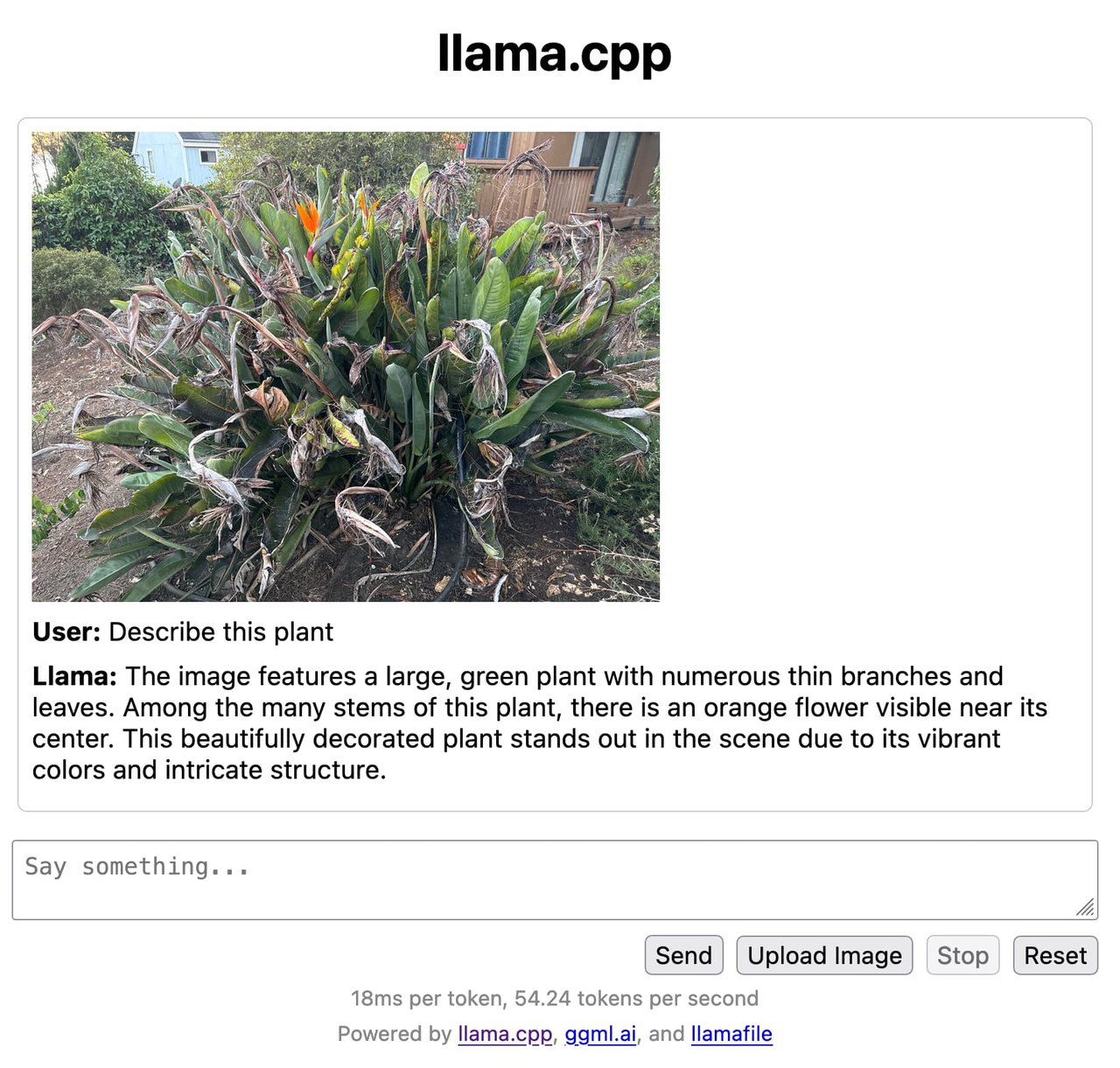

--cli 플래그로 질문 하나만 던지고 바로 답을 받을 수 있습니다. 스크립트나 자동화 작업에 유용합니다.--image 플래그로 사진을 첨부하면 AI가 사진 내용을 설명해줍니다. 멀티모달(텍스트+이미지) 모델인 LLaVA를 지원합니다.

▲ Llamafile 웹 채팅 UI. 사진을 올리면 AI가 내용을 설명해줍니다. 초당 54토큰 속도로 응답합니다.

지금 바로 써보기 — 3줄이면 끝

내 컴퓨터에서 AI를 실행하는 데 필요한 건 딱 3줄입니다. 가장 가벼운 모델(1.6GB)부터 시작해볼 수 있습니다.

# 1. 모델 다운로드 (1.6GB — Qwen 3.5 0.8B)

curl -LO https://huggingface.co/mozilla-ai/llamafile_0.10.0/resolve/main/Qwen3.5-0.8B-Q8_0.llamafile

# 2. 실행 권한 부여 (맥/리눅스)

chmod +x Qwen3.5-0.8B-Q8_0.llamafile

# 3. 실행 — 터미널 채팅 + 웹 서버가 동시에 뜹니다

./Qwen3.5-0.8B-Q8_0.llamafile윈도우 사용자는 파일 이름 뒤에 .exe를 붙여서 더블클릭하면 됩니다.

GPU를 최대한 활용하고 싶다면 실행할 때 --ngl 9999 옵션을 추가하면 됩니다. 이렇게 하면 AI 연산을 그래픽카드에 모두 넘겨서 속도가 크게 빨라집니다.

쓸 수 있는 AI 모델 — 1.6GB부터 19GB까지

v0.10에서는 13종의 사전 빌드 모델을 제공합니다. 내 컴퓨터 사양에 맞춰 골라 쓸 수 있습니다.

| 모델 | 크기 | 특징 |

|---|---|---|

| Qwen 3.5 0.8B | 1.6GB | 가장 가볍고 빠름, 입문용 |

| Qwen 3.5 4B | 4.1GB | 일상 대화 수준의 품질 |

| LLaVA v1.6 7B | 5.3GB | 사진을 이해하는 멀티모달 AI |

| Qwen 3.5 9B | 7.4GB | 균형 잡힌 성능 |

| gpt-oss 20B | 12GB | 고성능, GPU 권장 |

| Qwen 3.5 27B | 19GB | 최고 품질, 넉넉한 메모리 필요 |

Ollama, LM Studio와 뭐가 다른가

내 컴퓨터에서 AI를 돌리는 도구는 Ollama(깃허브 스타 16만)나 LM Studio가 이미 인기입니다. Llamafile이 이들과 다른 결정적 차이점은 설치 자체가 없다는 것입니다.

Ollama는 brew나 apt로 설치해야 하고, LM Studio는 앱을 내려받아야 합니다. Llamafile은 모델 파일 자체가 곧 실행 파일입니다. USB에 담아서 다른 컴퓨터에 꽂으면 바로 실행됩니다. 인터넷 연결도 필요 없습니다. 격리된 환경, 보안이 중요한 업무, 또는 "내 데이터가 절대 외부로 나가면 안 되는" 상황에서 특히 유용합니다.

이 업데이트가 중요한 이유

Mozilla는 DeepSpeech, Firefox OS 등 유망한 프로젝트를 여러 번 중단한 전력이 있습니다. Llamafile도 10개월간 업데이트가 없자 커뮤니티에서 "또 죽는 거 아니냐"는 불안이 커지고 있었습니다.

이번 v0.10은 단순 버그 수정이 아니라 빌드 시스템을 완전히 새로 설계한 구조적 변화입니다. llama.cpp 최신 버전을 자동으로 추적하는 워크플로우가 추가되었기 때문에, 앞으로 새 AI 모델이 나오면 Llamafile에서도 빠르게 지원될 수 있습니다. 이것은 프로젝트의 지속 가능성을 크게 높이는 변화입니다.

"AI를 써보고 싶은데 설치가 너무 복잡하다"는 분들에게 Llamafile은 여전히 가장 낮은 진입 장벽을 제공합니다. 파일 하나, 클릭 한 번. 그것이 전부입니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처