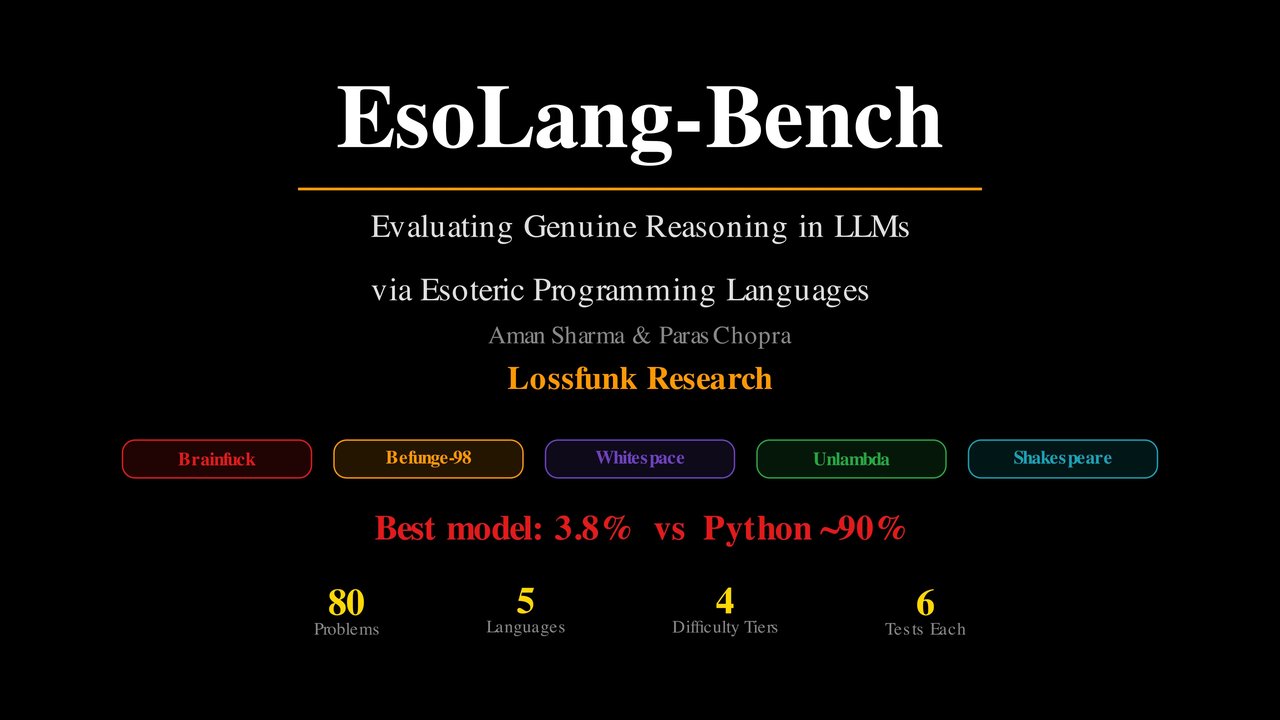

내 AI는 코드를 이해한 게 아니라 외운 거였다 — 낯선 언어 앞에서 3.8점

AI가 파이썬에서 90점을 받지만, 훈련 데이터가 거의 없는 5개 프로그래밍 언어에서는 3.8점에 그쳤습니다. 눈에 보이지 않는 문자로 짜는 Whitespace에서는 모든 AI가 0점. AI의 코딩 능력이 이해가 아닌 암기에 의존한다는 증거입니다.

AI에게 코드를 짜달라고 하면 순식간에 뚝딱 만들어줍니다. 그래서 많은 사람이 AI가 프로그래밍을 '이해'한다고 생각합니다. 그런데 인도 방갈로르의 AI 연구소 Lossfunk Research가 발표한 실험 결과가 이 믿음을 정면으로 뒤흔들었습니다. AI에게 '처음 보는' 프로그래밍 언어로 같은 문제를 풀게 했더니, 최고 성적이 3.8점이었습니다.

'시험 범위 밖' 문제를 내봤습니다

원리는 간단합니다. 학생이 시험 답을 외워서 맞힌 건지, 진짜 원리를 이해해서 맞힌 건지 알려면, 시험 범위에 없던 문제를 내면 됩니다.

연구팀은 '에소테릭 프로그래밍 언어(esoteric programming language)'라는 것을 활용했습니다. 이 언어들은 프로그래밍의 한계를 실험하기 위해 만들어진 독특한 언어입니다. AI가 학습할 때 참고할 수 있는 코드가 파이썬보다 1,000배에서 10만 배나 적습니다. 즉, AI가 '외울 답안지'가 거의 없는 셈입니다.

실험에 사용된 5개 언어를 쉽게 설명하면 이렇습니다:

Brainfuck — 명령어가 딱 8개뿐인 극단적으로 단순한 언어

Befunge-98 — 코드가 위·아래·좌·우 4방향으로 움직이는 2차원 언어

Whitespace — 눈에 보이지 않는 공백·탭·줄바꿈만으로 프로그래밍하는 언어

Unlambda — 변수가 아예 없는 수학적 언어

Shakespeare — 코드를 셰익스피어 희곡 형식으로 작성하는 언어

총 80개 문제를 4단계 난이도(쉬움·보통·어려움·매우 어려움)로 나누고, 각 문제마다 6개의 테스트를 수행했습니다.

파이썬 90점 vs 낯선 언어 3.8점

결과는 충격적이었습니다. 같은 논리의 문제를 풀었는데, 사용하는 언어만 바꿨을 뿐인데 점수가 폭락했습니다.

AI 모델별 성적표 (일반 모드)

GPT-5.2 — 3.8% (최고 성적)

O4-mini-high — 3.2%

Gemini 3 Pro — 2.8%

Qwen3-235B — 1.0%

Kimi K2 Thinking — 0.8%

AI 코딩 에이전트 모드 (도구 활용 가능)

코드를 실행해보고 수정하는 '에이전트 모드'에서도 결과는 크게 다르지 않았습니다.

Codex — 13.8%

Claude Code — 12.5%

특히 눈에 띄는 점이 세 가지 있습니다:

1. Whitespace 언어에서 모든 AI가 0점

눈에 보이지 않는 문자로만 프로그래밍하는 이 언어 앞에서 최신 AI 전부가 백지를 냈습니다.

2. '쉬움' 난이도 이상은 전부 0점

쉬운 문제에서 간신히 몇 개 맞힌 AI들이, 보통 난이도부터는 단 한 문제도 풀지 못했습니다.

3. 예제를 줘도, 반성 기회를 줘도 소용없었습니다

'답 예시 3개를 보여주는 방식(few-shot)'이나 '자기 답을 되돌아보는 방식(self-reflection)' 모두 의미 있는 개선이 없었습니다. 연구팀은 이것이 "AI가 학습 데이터의 패턴을 활용하는 것이지, 진짜 새로운 것을 배우는 게 아니라는 증거"라고 결론지었습니다.

언어별 상세 성적

패턴이 명확합니다. GitHub에 참고할 코드가 많을수록 AI 성적이 높았습니다. Brainfuck은 5,000개 저장소가 있어 그나마 13.8%를 기록했지만, 200개뿐인 Whitespace에서는 완전한 0점이었습니다. AI가 '논리'를 이해하는 게 아니라 '패턴'을 외웠다는 결정적 증거입니다.

AI에게 코드를 맡기는 분들에게

이 연구가 말하는 건 "AI가 쓸모없다"가 아닙니다. 오히려 반대입니다. AI가 잘하는 영역과 못하는 영역이 분명하다는 뜻입니다.

AI가 잘하는 상황

• 파이썬, 자바스크립트 같은 흔한 언어로 흔한 작업을 할 때

• 웹사이트 만들기, 데이터 정리, 반복 작업 자동화 등 '많이 본 패턴'일 때

• 기존 코드를 참고해서 비슷한 걸 만들 때

AI를 조심해야 하는 상황

• 새로운 방식이나 독창적인 로직을 설계할 때

• 흔하지 않은 도구나 언어를 사용할 때

• '왜 이렇게 동작하는지' 설명을 요구할 때 — AI의 설명이 맞는지 반드시 확인이 필요합니다

바이브코딩(자연어로 AI에게 코드를 시키는 방식)을 즐기는 분들에게도 중요한 시사점입니다. AI가 자신 있게 내놓는 코드라도, 그 뒤의 논리를 AI가 진짜 이해한 건 아닐 수 있습니다. 결과물이 돌아가는지 확인하고, 핵심 로직은 직접 검증하는 습관이 중요합니다.

직접 확인해보기

연구팀은 벤치마크 전체를 오픈소스로 공개했습니다. 개발자라면 직접 실행해볼 수 있습니다.

# 설치

pip install -e .

# Brainfuck 인터프리터 실행 예시

esolang-interpret -l brainfuck -c '++++++[>++++++<-]>.'

# HuggingFace에서 벤치마크 데이터셋 불러오기

from datasets import load_dataset

ds = load_dataset("Lossfunk/Esolang-Bench")인터랙티브 리더보드와 상세 차트는 EsoLang-Bench 공식 웹사이트에서 확인할 수 있습니다. 논문 전문은 arXiv에서 무료로 읽을 수 있습니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기