내 컴퓨터에서 GPU 없이 AI를 무료로 돌린다 — 마이크로소프트 BitNet, 깃허브 스타 3만 5천

마이크로소프트가 만든 오픈소스 AI 도구 BitNet으로 GPU 없이 CPU만으로 AI를 최대 6배 빠르게 실행할 수 있습니다. 에너지 소비는 최대 82% 절감, 1000억 파라미터 모델도 일반 PC에서 작동합니다.

비싼 그래픽카드(GPU) 없이도 1,000억 개 파라미터짜리 AI 모델을 내 컴퓨터 CPU에서 사람이 읽는 속도(초당 5~7 단어)로 실행할 수 있는 무료 오픈소스 도구가 깃허브 스타 3만 5천을 돌파했습니다. 마이크로소프트 연구팀이 만든 BitNet은 AI 모델의 내부 숫자를 극단적으로 압축해서, 고가의 GPU 장비 없이도 일반 컴퓨터에서 AI를 실행할 수 있게 해줍니다.

AI를 딱 세 가지 숫자로 압축하는 기술

보통 AI 모델은 하나의 숫자를 표현할 때 16비트(65,536가지 값)나 32비트를 사용합니다. 고화질 사진처럼 정밀하지만, 그만큼 저장 공간과 계산 능력이 많이 필요합니다. ChatGPT 같은 대형 AI를 돌리려면 수천만 원짜리 GPU가 필요한 이유입니다.

BitNet의 핵심 기술인 1.58비트 양자화(모델 숫자를 극도로 줄이는 압축 기술)는 모든 숫자를 딱 세 가지 값(-1, 0, 1)으로 바꿔버립니다. 비유하면, 일반 AI가 수만 가지 색의 물감으로 그림을 그린다면 BitNet은 연필 한 자루로 스케치하는 것입니다. 놀라운 점은 이 '연필 스케치'의 정확도가 원본과 거의 같다는 것입니다.

마이크로소프트 연구팀의 논문에 따르면, 1.58비트 모델이 동일 크기의 일반 모델과 거의 같은 정확도를 보여줬습니다. 0.7B(7억 파라미터) 모델 기준으로, 일반 모델의 정확도 45.5% 대비 BitNet은 44.5%를 기록했습니다. 1%p 차이로 메모리와 전력을 수십 배 아낀 셈입니다.

CPU에서 최대 6배 빠르고, 전기는 82% 절약

실제 벤치마크 핵심 수치

속도 2.37~6.17배 향상

에너지 72~82% 절감

속도 1.37~5.07배 향상

에너지 55~70% 절감

일반 PC CPU에서

초당 5~7 토큰 생성

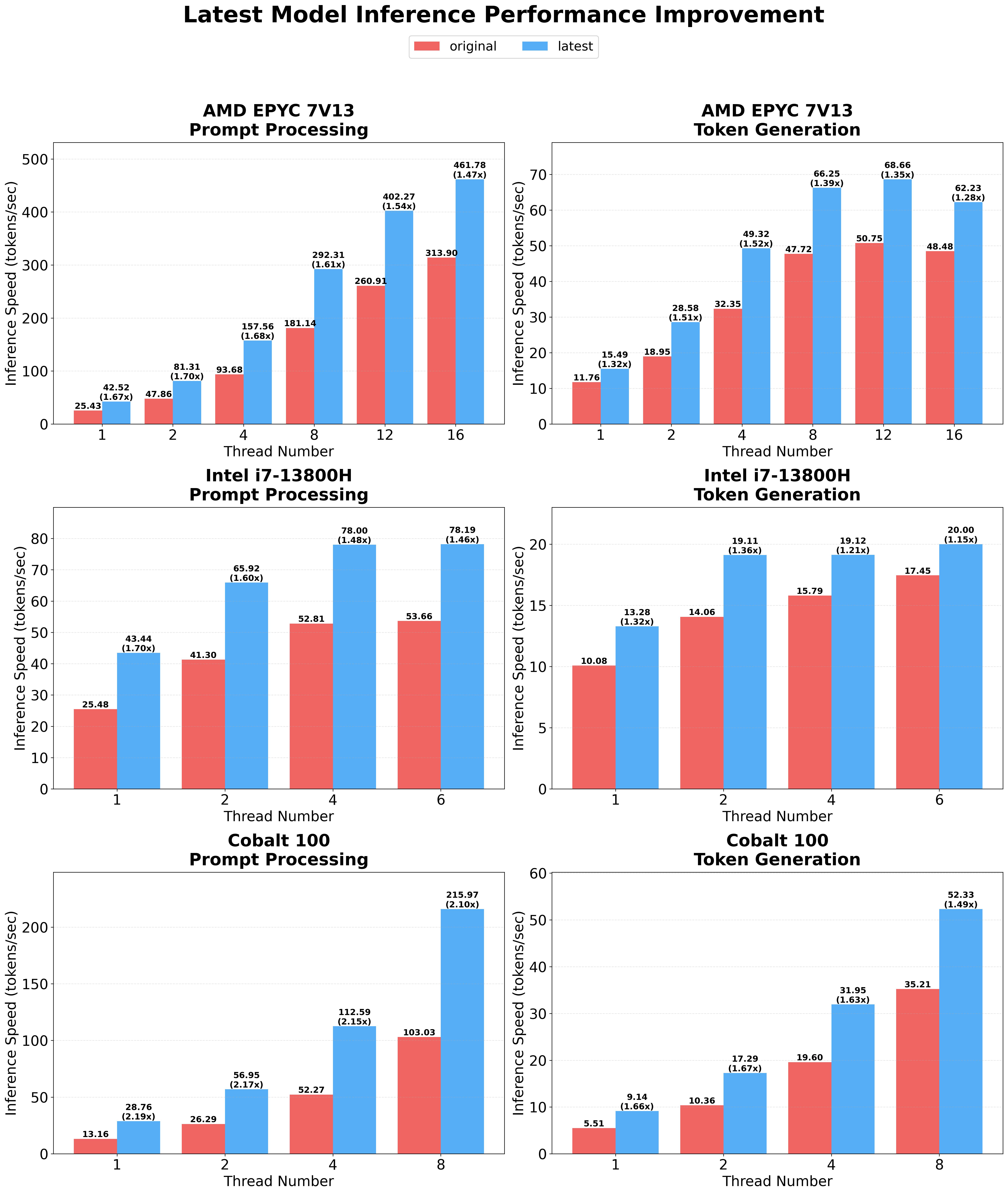

위 성능 차트에서 파란 막대가 BitNet 최적화 후 속도입니다. AMD 서버 CPU에서 16스레드 기준 초당 461 토큰을 처리하며, 이는 기존 대비 1.47배 추가 향상된 수치입니다. 2026년 1월 업데이트에서 병렬 커널 최적화를 적용해 기존 BitNet 대비 1.15~2.1배 추가 속도 향상을 달성했습니다.

어떤 AI 모델을 돌릴 수 있나

BitNet은 다양한 크기의 1-bit AI 모델을 지원합니다.

직접 설치해서 사용하는 방법

개발자용 — BitNet.cpp 직접 빌드

Python 3.9 이상, CMake, Clang 컴파일러가 필요합니다. 터미널(명령 프롬프트)에서 아래 명령어를 순서대로 실행합니다.

# 저장소 복제

git clone --recursive https://github.com/microsoft/BitNet.git

cd BitNet

# 가상환경 생성 및 활성화

conda create -n bitnet python=3.9 -y

conda activate bitnet

# 의존성 설치 및 모델 다운로드

pip install -r requirements.txt

huggingface-cli download 1bitLLM/bitnet_b1_58-2B-4T --local-dir models/BitNet-b1.58-2B-4T

# 빌드 및 실행

python setup_env.py -md models/BitNet-b1.58-2B-4T -q i2_s

python run_inference.py -m models/BitNet-b1.58-2B-4T -p "오늘 날씨가 좋다" -n 100비개발자용 — LM Studio나 Ollama로 간편 실행

빌드가 어렵다면, BitNet 1-bit 모델을 LM Studio나 Ollama에서 바로 사용할 수 있습니다. GGUF 형식으로 변환된 모델을 검색해서 다운로드하면, 클릭 몇 번으로 내 컴퓨터에서 AI 챗봇을 실행할 수 있습니다.

GPU 없는 AI 시대가 왜 중요한가

현재 AI를 제대로 돌리려면 엔비디아 H100 GPU 한 장에 약 4,000만 원이 필요합니다. BitNet 같은 1-bit 기술이 발전하면, 이 비용 장벽이 크게 낮아집니다. 마이크로소프트 연구팀은 논문에서 "1-bit LLM이 새로운 스케일링 패러다임을 정의한다"고 밝혔습니다.

이미 이 방향으로 여러 프로젝트가 진행되고 있습니다. flash-moe는 MoE(전문가 혼합) 방식으로 대형 모델을 작은 메모리에서 돌리고, NVIDIA GreenBoost는 시스템 RAM을 GPU 메모리처럼 활용합니다. BitNet은 이들과 다른 접근 — 모델 자체를 근본적으로 가볍게 만드는 방식입니다.

35,717개의 깃허브 스타와 이번 주에만 6,457개의 새 스타가 추가된 것은, GPU 없이 AI를 돌리려는 수요가 얼마나 큰지를 보여줍니다. 개인 개발자, 학생, 소규모 회사 — GPU를 구매하거나 클라우드 요금을 낼 여유가 없는 사람들에게 BitNet은 AI 접근성의 문을 열어줍니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기

출처