내 맥북에서 209GB짜리 초거대 AI가 돌아간다 — 메모리 6GB면 충분합니다

48GB 맥북에서 3970억 파라미터 AI를 초당 5.5단어 속도로 실행하는 오픈소스 도구 flash-moe가 공개됐습니다. 애플이 2023년 발표한 'LLM in a Flash' 기술을 실제로 구현한 결과물로, 메모리 6GB만 사용합니다.

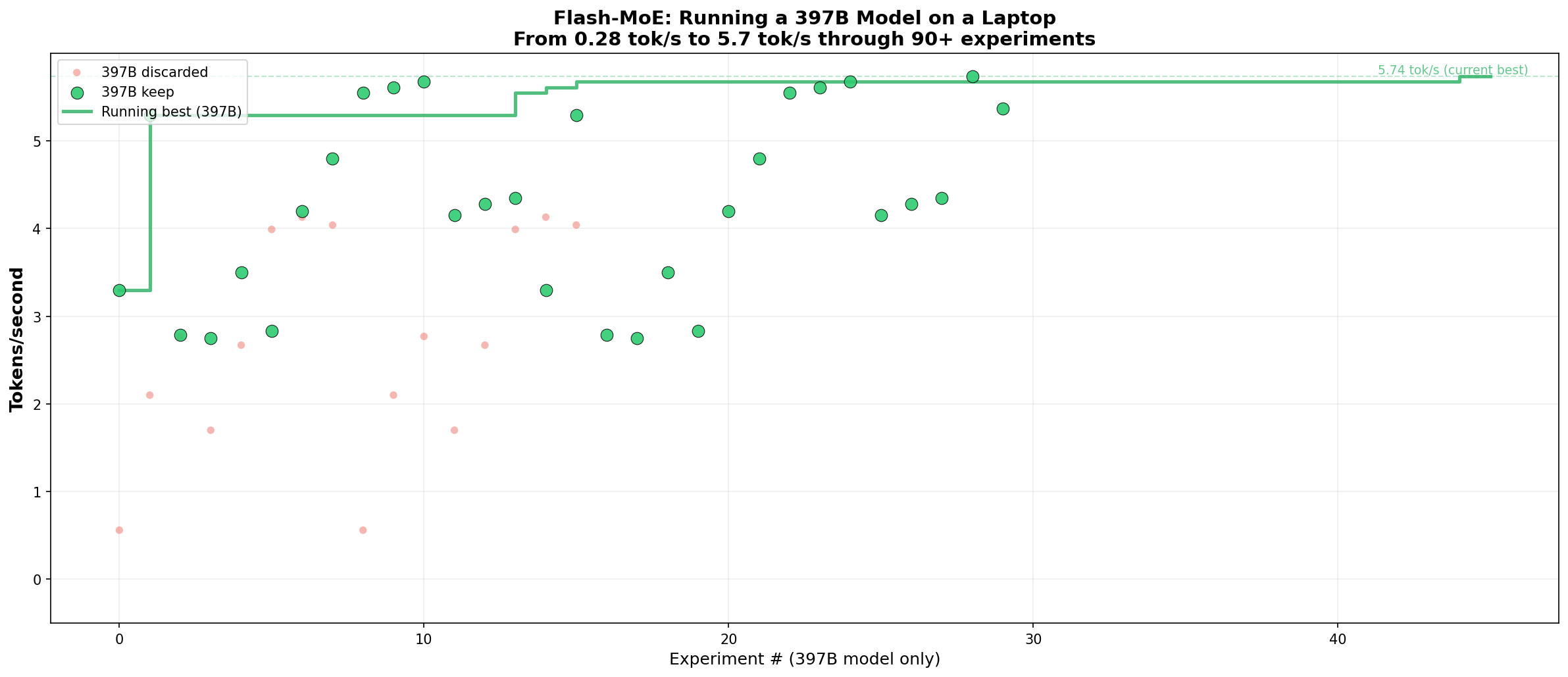

맥북 메모리가 48GB인데, 209GB짜리 AI를 돌릴 수 있을까요? 결론부터 말하면 가능합니다. 비밀은 맥북의 초고속 SSD에 있었습니다. 개발자 Dan Woods가 AI 코딩 도우미 Claude에게 90번의 실험을 시켜서 만든 오픈소스 도구 flash-moe가 그 결과물입니다.

- 209GB 크기의 AI(Qwen 3.5, 3970억 파라미터)를 48GB 맥북에서 실행

- 실제로 사용하는 메모리는 6~9GB뿐 — 나머지는 SSD에서 실시간으로 가져옴

- 속도: 초당 5.5단어(최대 7.05단어) — 대화가 가능한 수준

- 애플이 2023년 발표한 'LLM in a Flash' 논문의 기술을 실제로 구현

- AI(Claude)가 90번 실험하고, 연구 논문까지 직접 작성

애플이 3년 전에 깔아둔 포석

2023년 12월, 애플 연구팀은 'LLM in a Flash'라는 논문을 발표했습니다. 핵심 아이디어는 간단합니다. AI의 뇌(가중치)를 전부 메모리에 올리지 말고, SSD에 저장해두고 필요한 부분만 그때그때 가져오자는 것입니다.

일반 컴퓨터의 SSD는 느려서 이 방식이 실용적이지 않았습니다. 하지만 애플 실리콘 맥북의 SSD는 다릅니다. 초당 17.5GB를 읽을 수 있는 초고속 저장장치가 메모리와 직접 연결되어 있기 때문입니다. 애플 논문은 이 하드웨어 특성을 활용하면 메모리보다 2배 큰 AI도 실행할 수 있고, 기존 대비 GPU에서 20~25배 빠른 속도를 낼 수 있다고 밝혔습니다.

하지만 논문은 이론이었을 뿐, 실제로 수백억 파라미터급 대형 AI를 이 방식으로 돌린 사람은 거의 없었습니다. Dan Woods가 바로 그 '실제 구현'에 도전한 것입니다.

AI에게 AI 연구를 시킨 90번의 실험

Dan Woods는 'autoresearch(자동 연구)' 패턴을 사용했습니다. 직접 코드를 짜는 대신, Claude Opus 4.6에게 실험을 설계하고 실행하도록 시킨 것입니다. 총 90번이 넘는 실험을 거쳐, Claude는 다음을 만들어냈습니다.

- 5,000줄의 C/Objective-C 추론 엔진 코드

- 1,100줄의 Metal GPU 셰이더(맥 전용 그래픽 처리 코드)

- 2비트 양자화(AI 뇌를 압축하는 기술) 도구

- 연구 논문 PDF까지 — flash-moe 논문 원문

사이먼 윌리슨(Simon Willison)은 자신의 블로그에서 이 프로젝트를 소개하면서, "AI가 AI 연구를 수행하고 논문까지 쓰는 시대"라고 평했습니다. 다만 출력 품질에 대해서는 아직 검증이 부족하다는 점도 지적했습니다.

어떻게 209GB를 6GB에 우겨넣나

flash-moe가 사용한 AI는 Qwen 3.5-397B-A17B입니다. '397B'는 총 3,970억 개의 파라미터(AI의 뉴런)가 있다는 뜻이고, 'A17B'는 그중 한 번에 170억 개만 활성화된다는 뜻입니다. 이런 구조를 MoE(Mixture of Experts, 전문가 혼합)라고 합니다. 쉽게 말해 512명의 전문가 중 4명만 돌아가며 일하는 구조입니다.

이 특성을 활용한 전략은 이렇습니다.

1단계 — SSD에 전문가를 저장

512명의 전문가 가중치를 맥북 SSD에 저장합니다. 총 209GB(2비트 압축 시 120GB)입니다.

2단계 — 필요한 4명만 불러오기

단어 하나를 생성할 때마다 라우팅 매트릭스(교통 정리 담당)가 "이번엔 전문가 #7, #142, #305, #488이 필요해"라고 알려주면, 그 4명의 데이터만 SSD에서 가져옵니다.

3단계 — GPU에서 계산

가져온 데이터를 맥의 GPU에서 처리하고, 다음 단어를 생성합니다. 이 과정이 한 층당 3.14밀리초밖에 안 걸립니다.

결과적으로 메모리에 상주하는 데이터는 비전문가 가중치(임베딩 테이블, 라우팅 행렬 등) 5.5GB와 GPU 버퍼 약 200MB뿐입니다. 나머지 39~42GB의 메모리는 운영체제와 다른 작업에 그대로 쓸 수 있습니다.

실제 성능 — 대화가 되는 속도인가

MacBook Pro M3 Max(48GB)에서 측정한 결과입니다.

| 설정 | 속도 | 디스크 사용 |

|---|---|---|

| 2비트 압축, 전문가 4명 | 5.55 단어/초 | 120GB |

| 4비트, 전문가 4명 (웜 캐시) | 4.80 단어/초 | 209GB |

| 4비트, 전문가 4명 (콜드 캐시) | 2.83 단어/초 | 209GB |

| 최고 속도 (단일 토큰) | 7.05 단어/초 | 120GB |

초당 5.5단어는 사람이 읽는 속도보다 빠릅니다. ChatGPT나 Claude를 사용할 때 텍스트가 흘러나오는 것과 비슷한 체감 속도입니다. 인터넷 없이, 내 맥북에서, 클라우드 비용 0원으로 이 수준의 AI를 실행할 수 있다는 뜻입니다.

직접 해볼 수 있나?

솔직히 말하면 아직 쉽지 않습니다. 다음 조건이 필요합니다.

- 하드웨어: Apple M3 Max 이상 + 48GB 이상 메모리 + 1TB SSD

- 저장 공간: 2비트 기준 120GB, 4비트 기준 209GB

- 기술 수준: 터미널에서 컴파일·실행할 수 있는 정도

조건이 된다면 아래 명령어로 시작할 수 있습니다.

git clone https://github.com/danveloper/flash-moe.git

cd flash-moe/metal_infer

make

# 2비트 모드로 대화 시작

./chat --2bit다만 모델 가중치를 Hugging Face에서 다운로드하고 변환하는 과정이 별도로 필요합니다. 자세한 방법은 GitHub 저장소에서 확인할 수 있습니다.

주의할 점 — 아직 실험 단계

사이먼 윌리슨은 이 프로젝트를 소개하면서 중요한 점을 짚었습니다. Claude가 "2비트 품질이 4비트와 구분할 수 없다"고 주장했지만, 그 평가 방법이 충분히 상세하지 않다는 것입니다. 즉, 초거대 AI를 이렇게 극단적으로 압축하면 답변 품질이 얼마나 떨어지는지 아직 확실하지 않습니다.

또한 이 프로젝트는 Apple Silicon 맥 전용입니다. Windows나 Linux에서는 동작하지 않습니다. 애플의 통합 메모리 구조와 초고속 SSD가 이 기술의 핵심이기 때문입니다.

왜 이게 중요한가 — AI 민주화의 다음 단계

지금까지 수천억 파라미터급 AI를 돌리려면 수천만 원짜리 GPU 서버가 필요했습니다. flash-moe는 300만 원대 맥북으로 같은 크기의 AI를 실행할 수 있다는 가능성을 보여줍니다.

더 주목할 점은 AI가 AI 연구를 수행하는 방식입니다. Dan Woods는 직접 Metal 코드를 짜지 않았습니다. Claude에게 "이 논문의 아이디어를 구현해봐"라고 시키고, 90번의 실험 결과를 분석하게 하고, 논문까지 쓰게 했습니다. 이것이 바로 autoresearch(자동 연구) 패턴 — AI를 연구 보조가 아닌 연구 실행자로 활용하는 방식입니다.

아직은 실험 단계이고, 고가의 맥북이 필요하고, 품질 검증도 부족합니다. 하지만 방향은 분명합니다. 클라우드에 의존하지 않고, 내 컴퓨터에서, 최고 수준의 AI를 실행하는 시대가 생각보다 빨리 올 수 있습니다.

관련 콘텐츠 — Easy클코로 AI 시작하기 | 무료 학습 가이드 | AI 뉴스 더보기